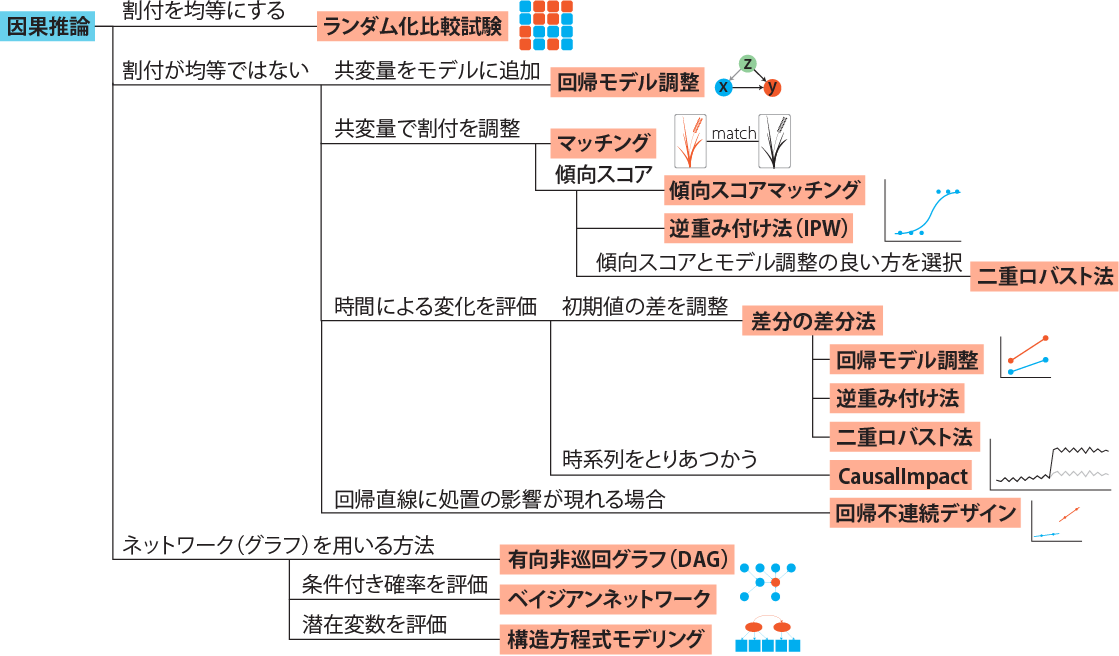

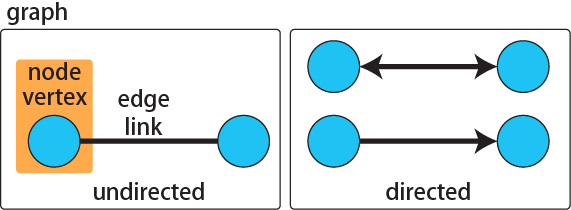

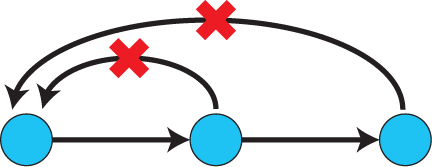

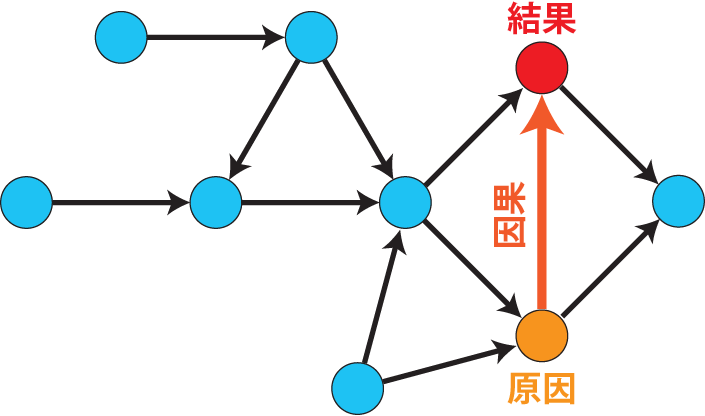

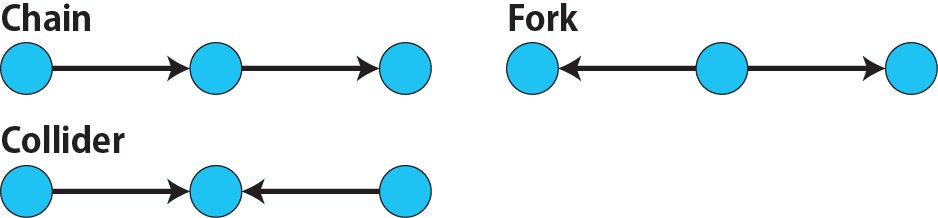

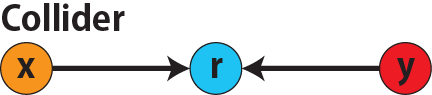

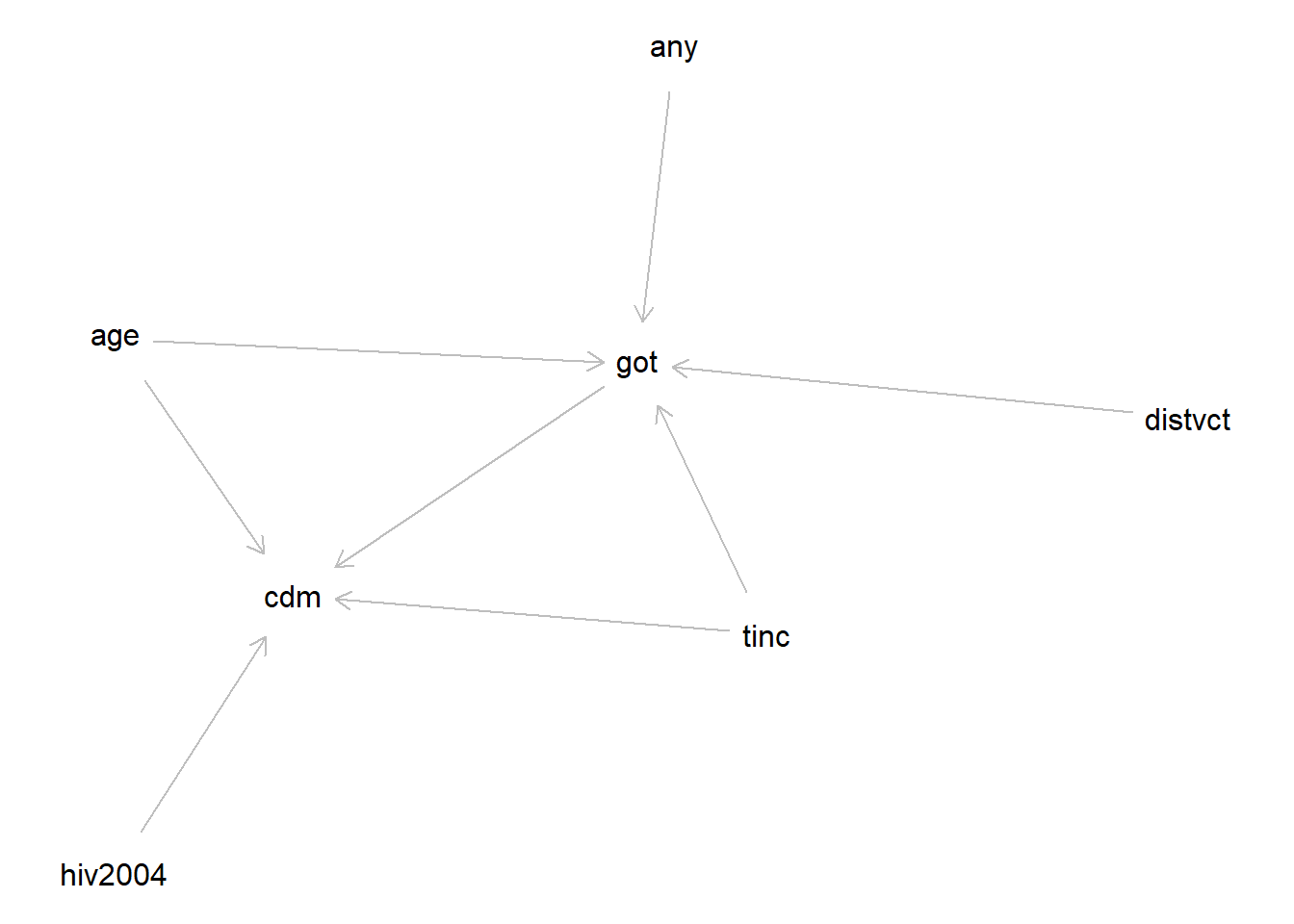

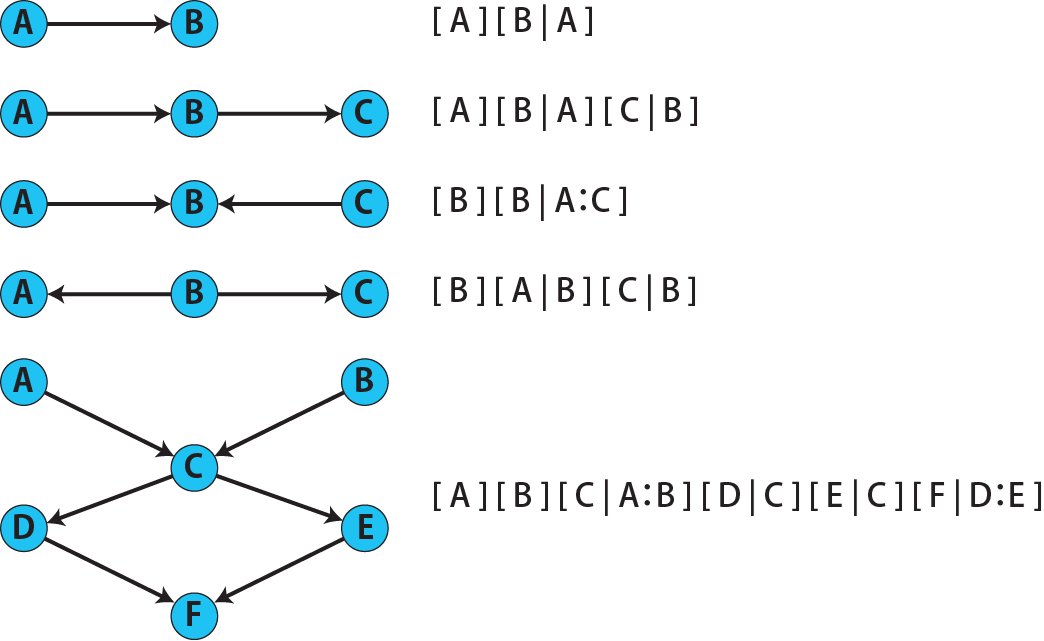

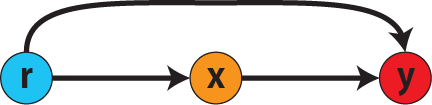

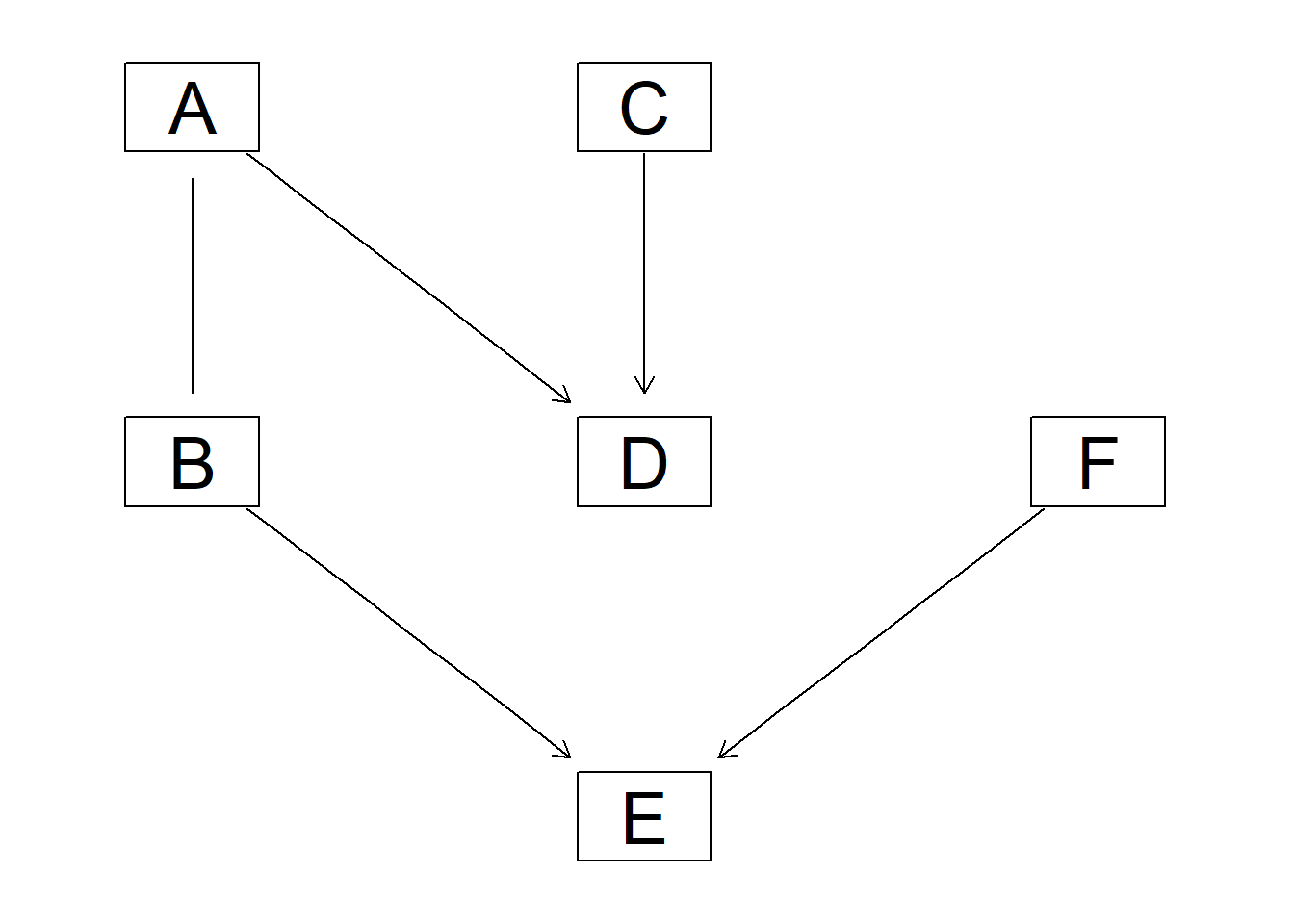

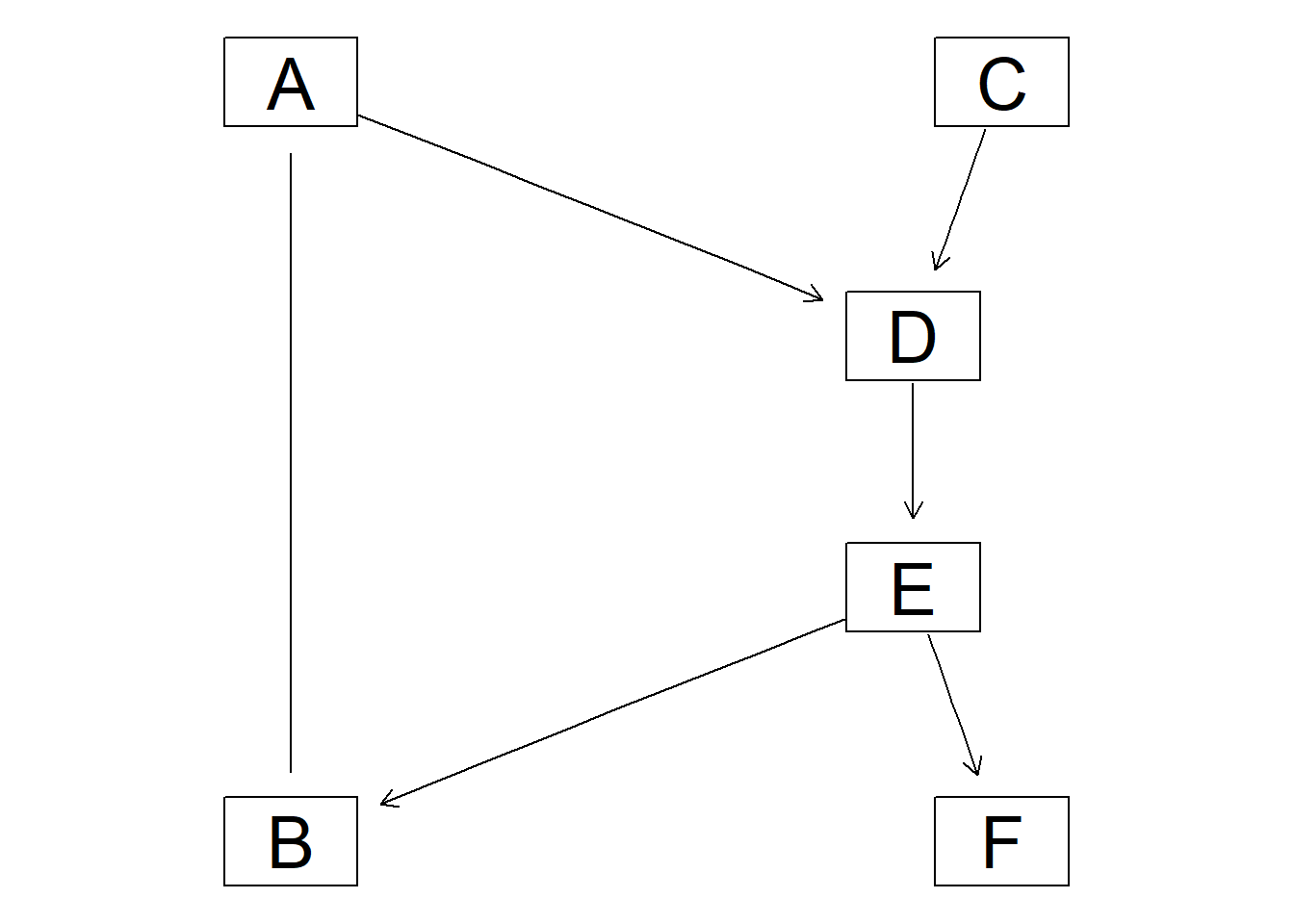

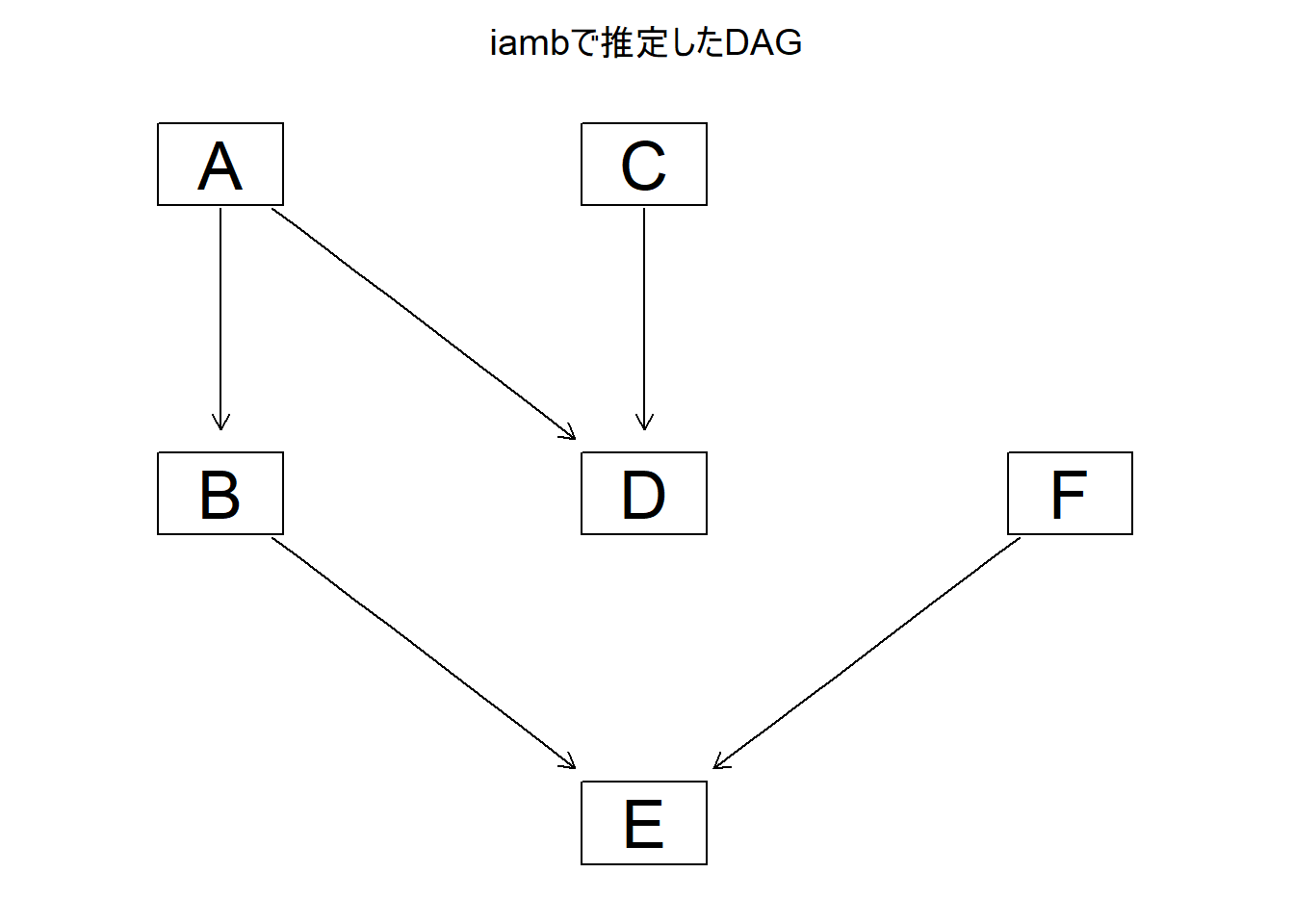

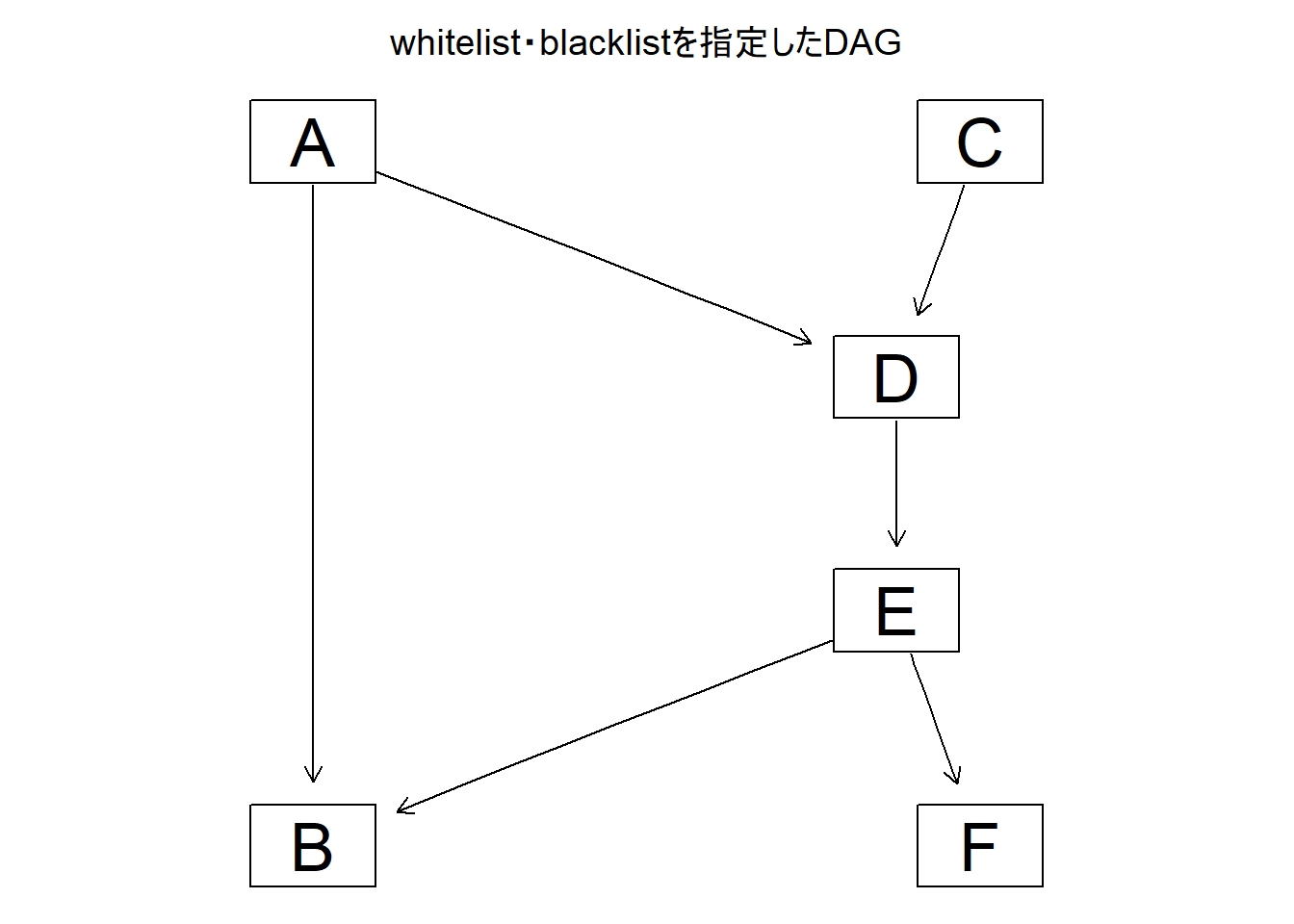

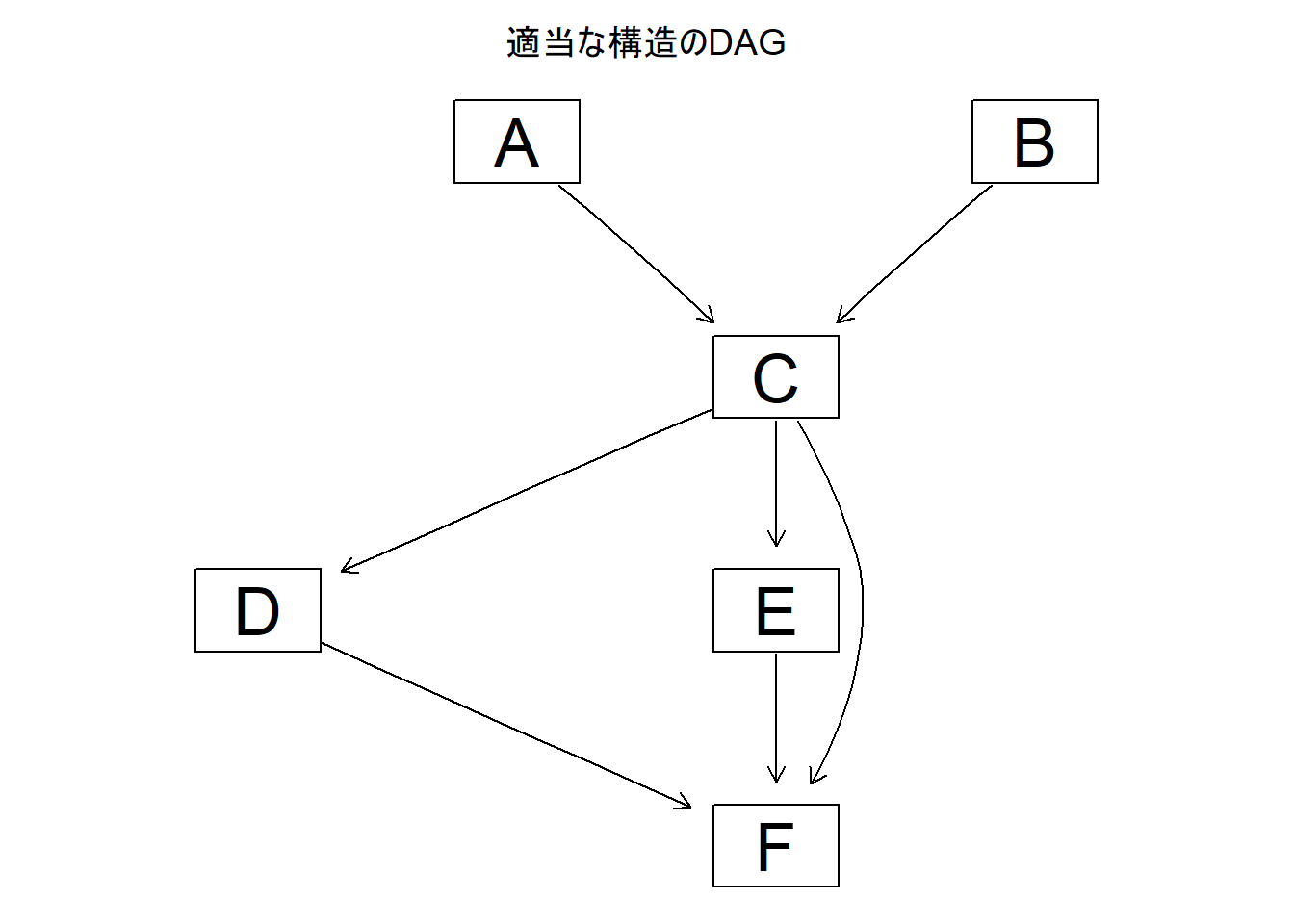

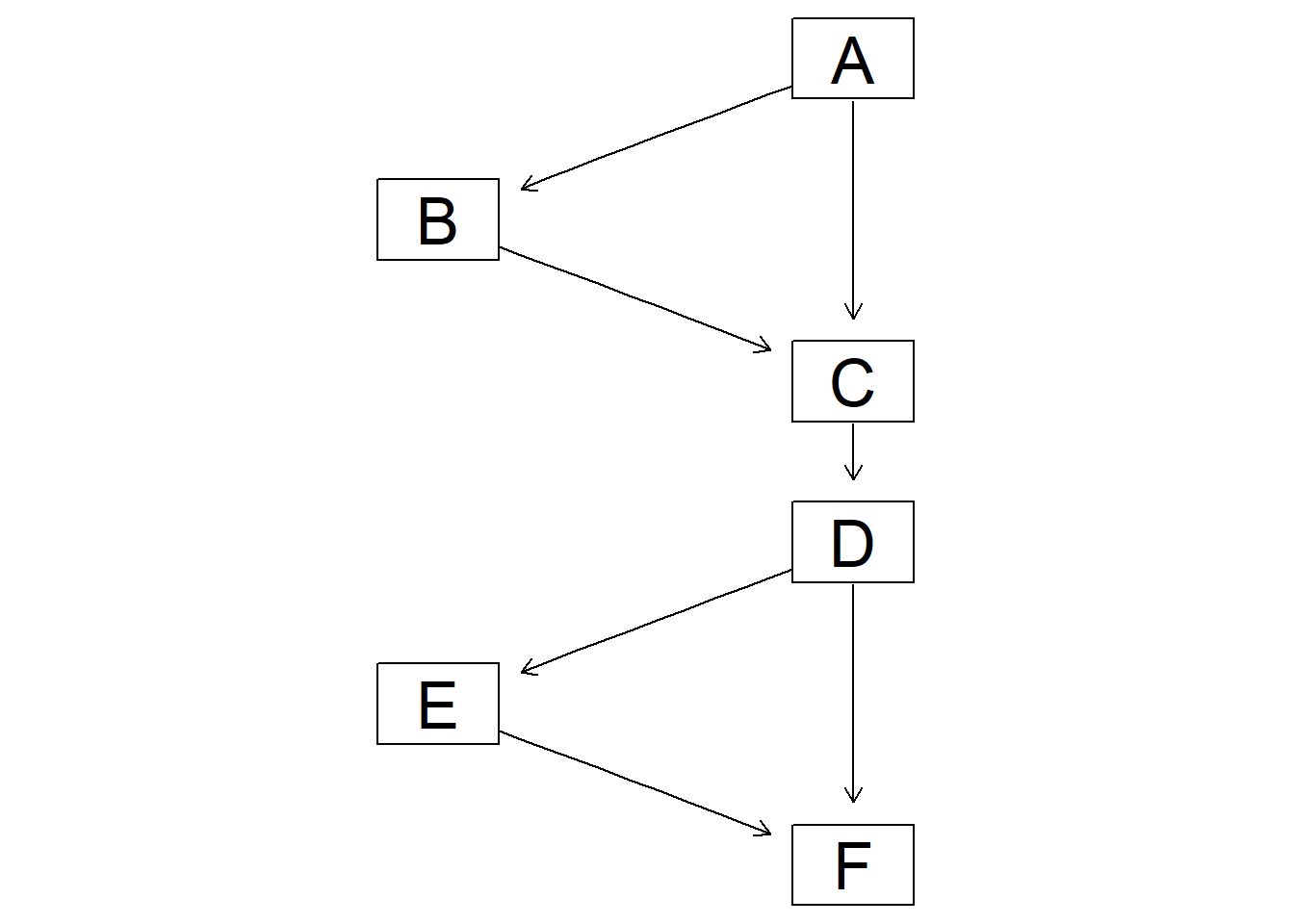

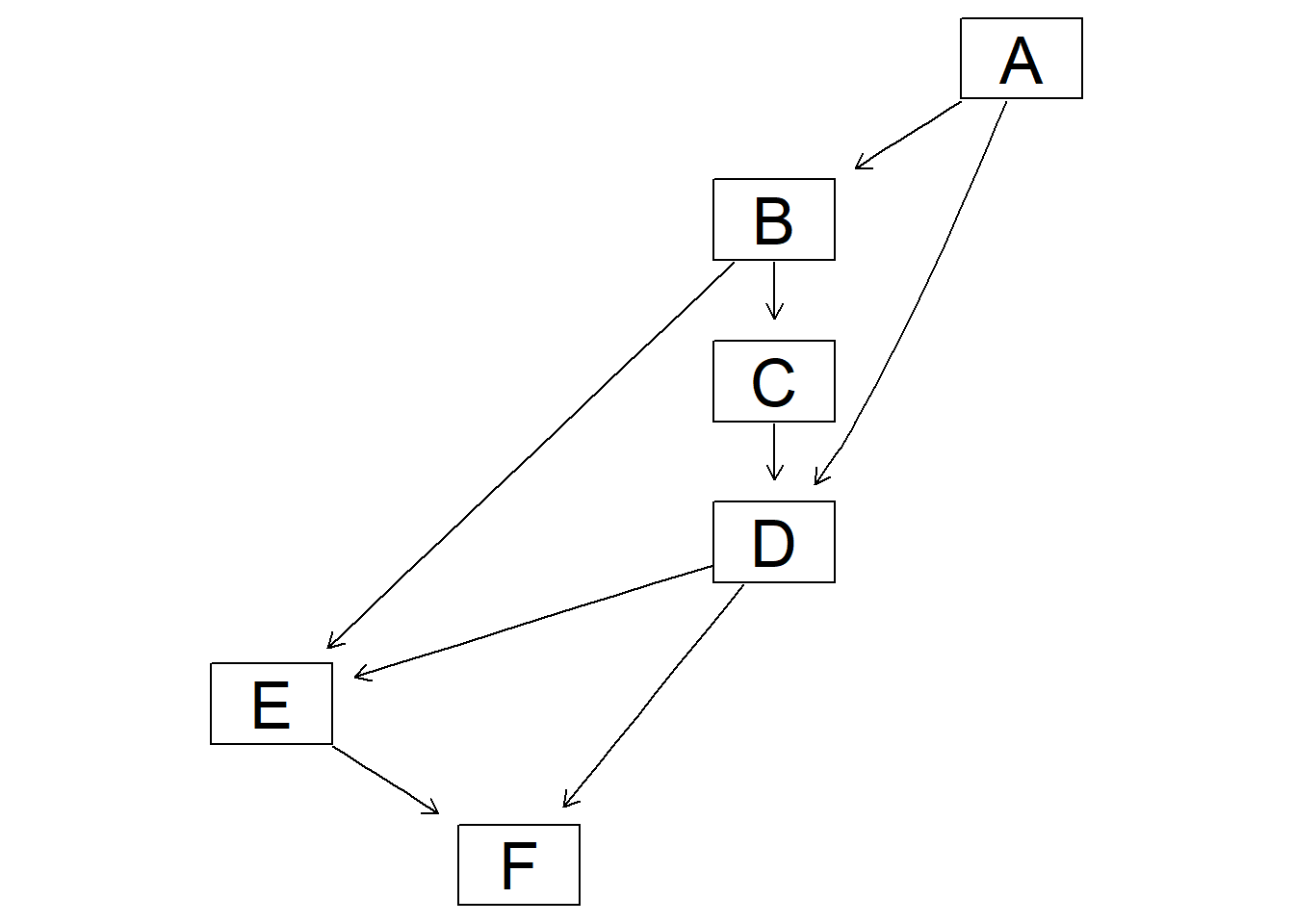

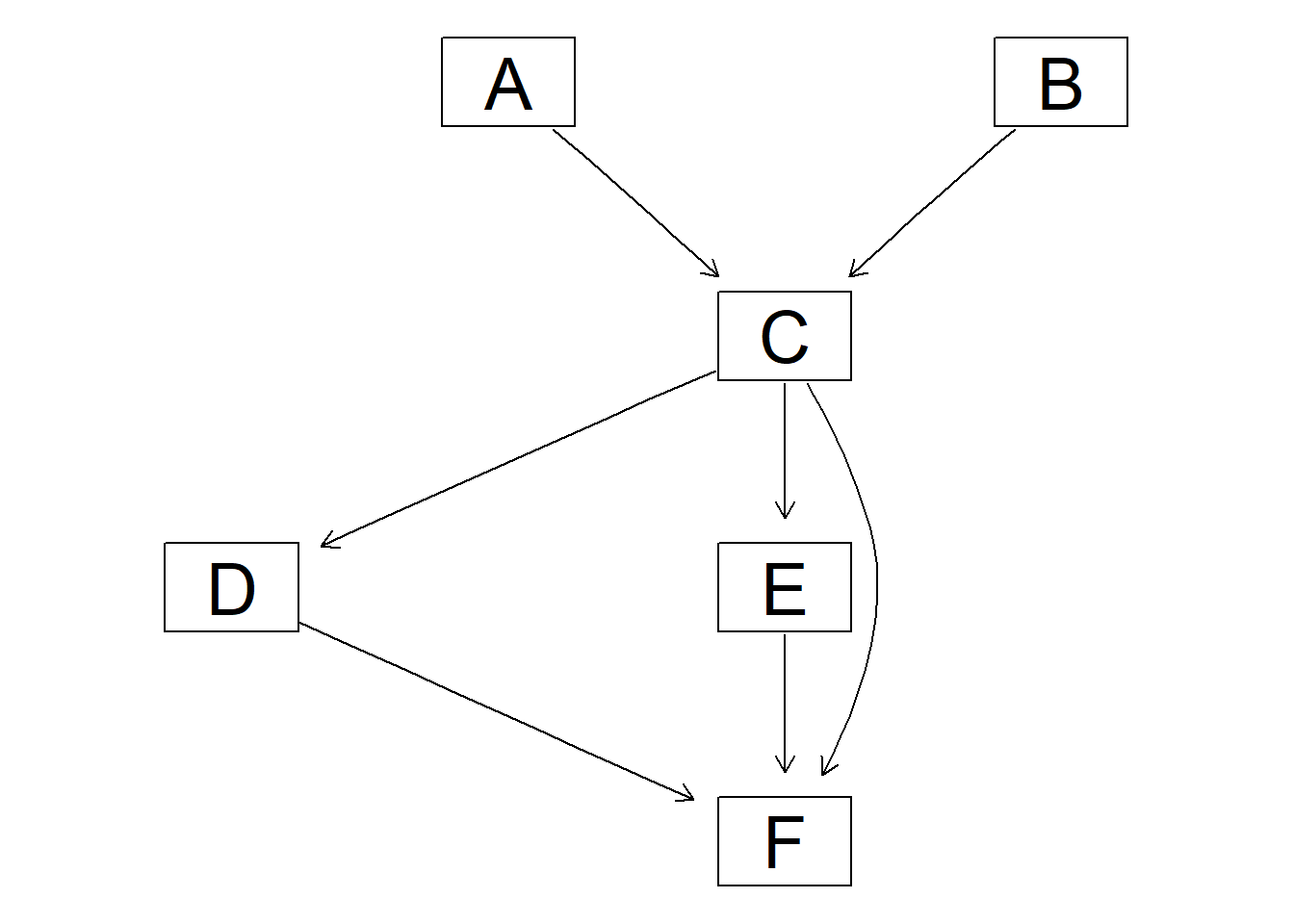

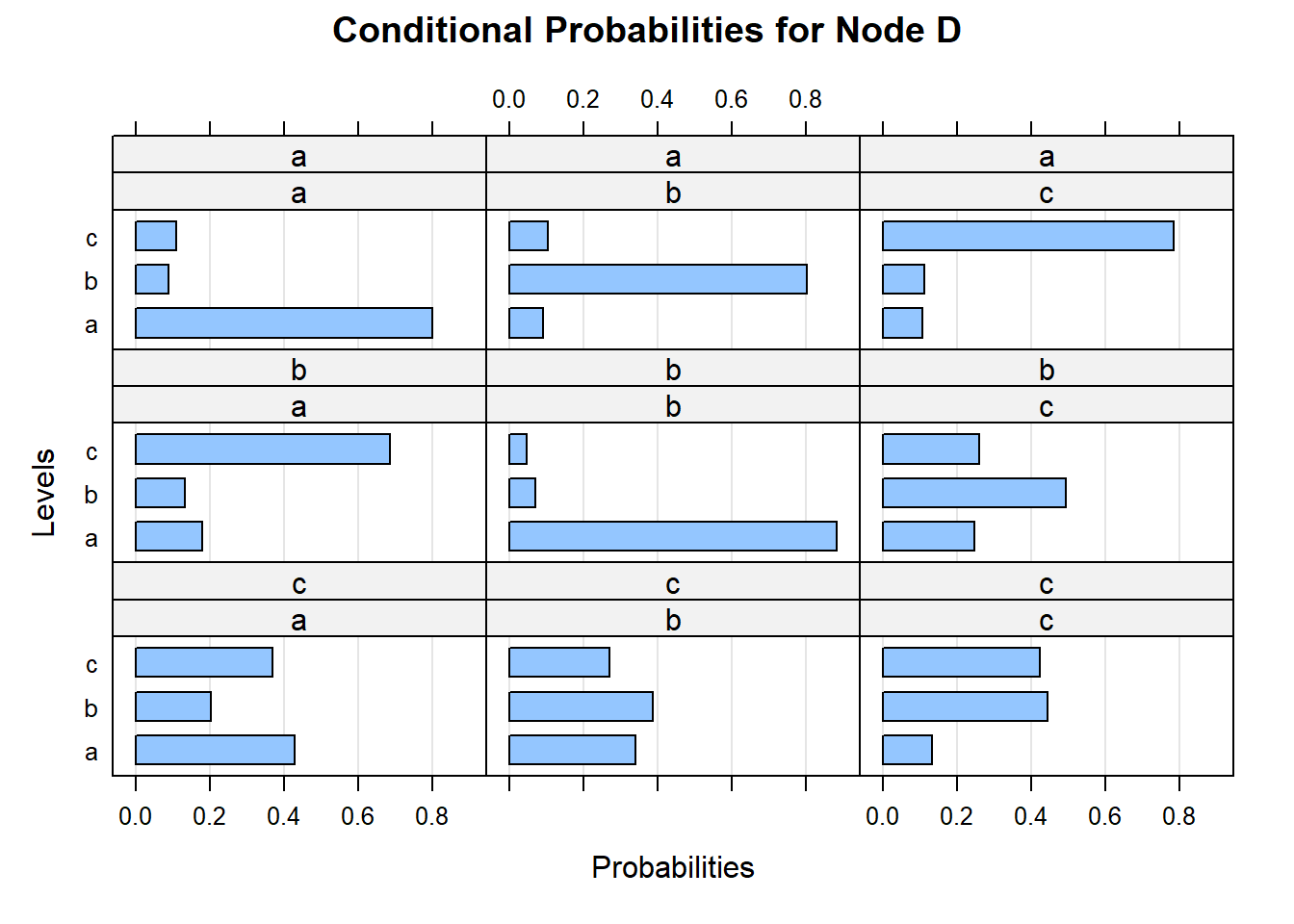

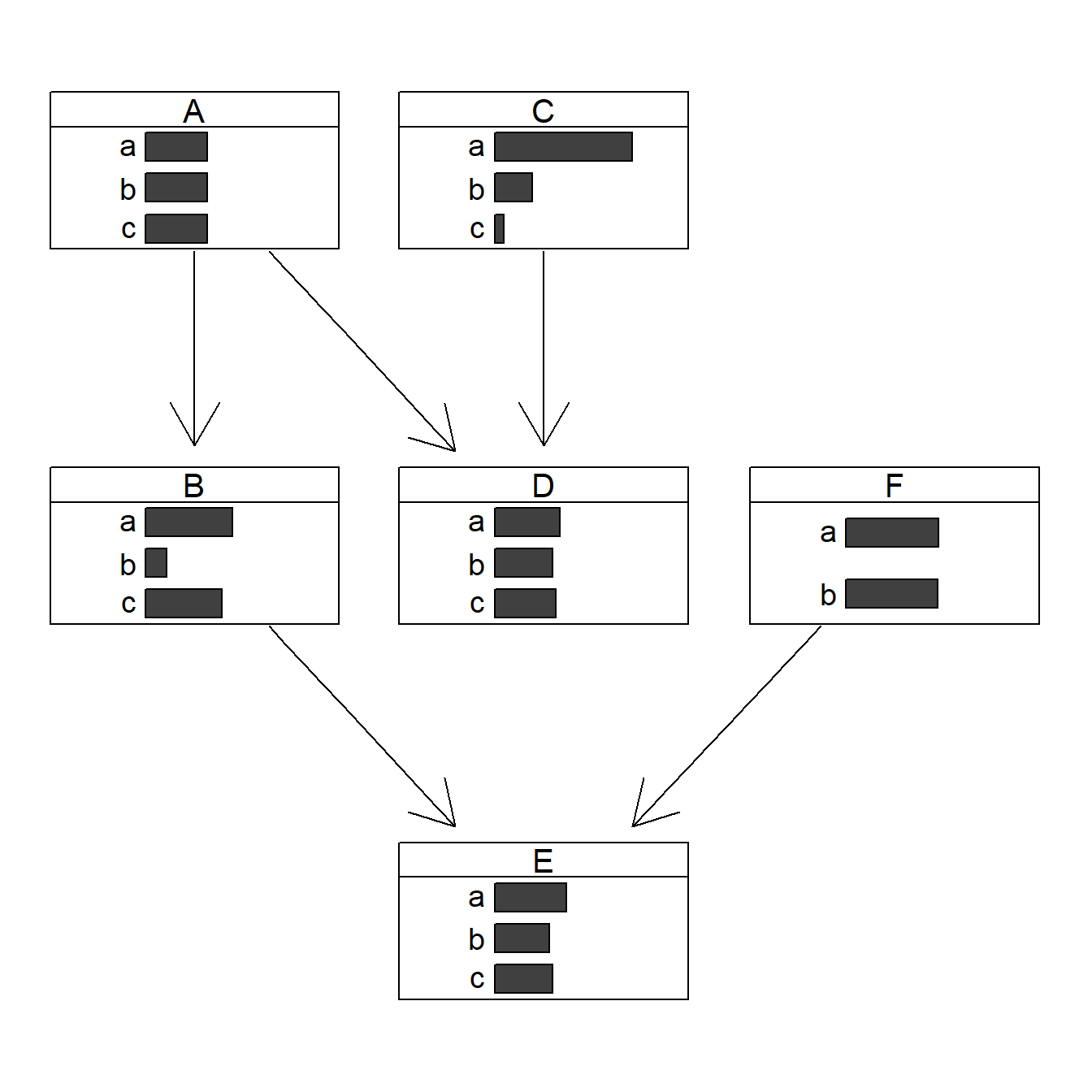

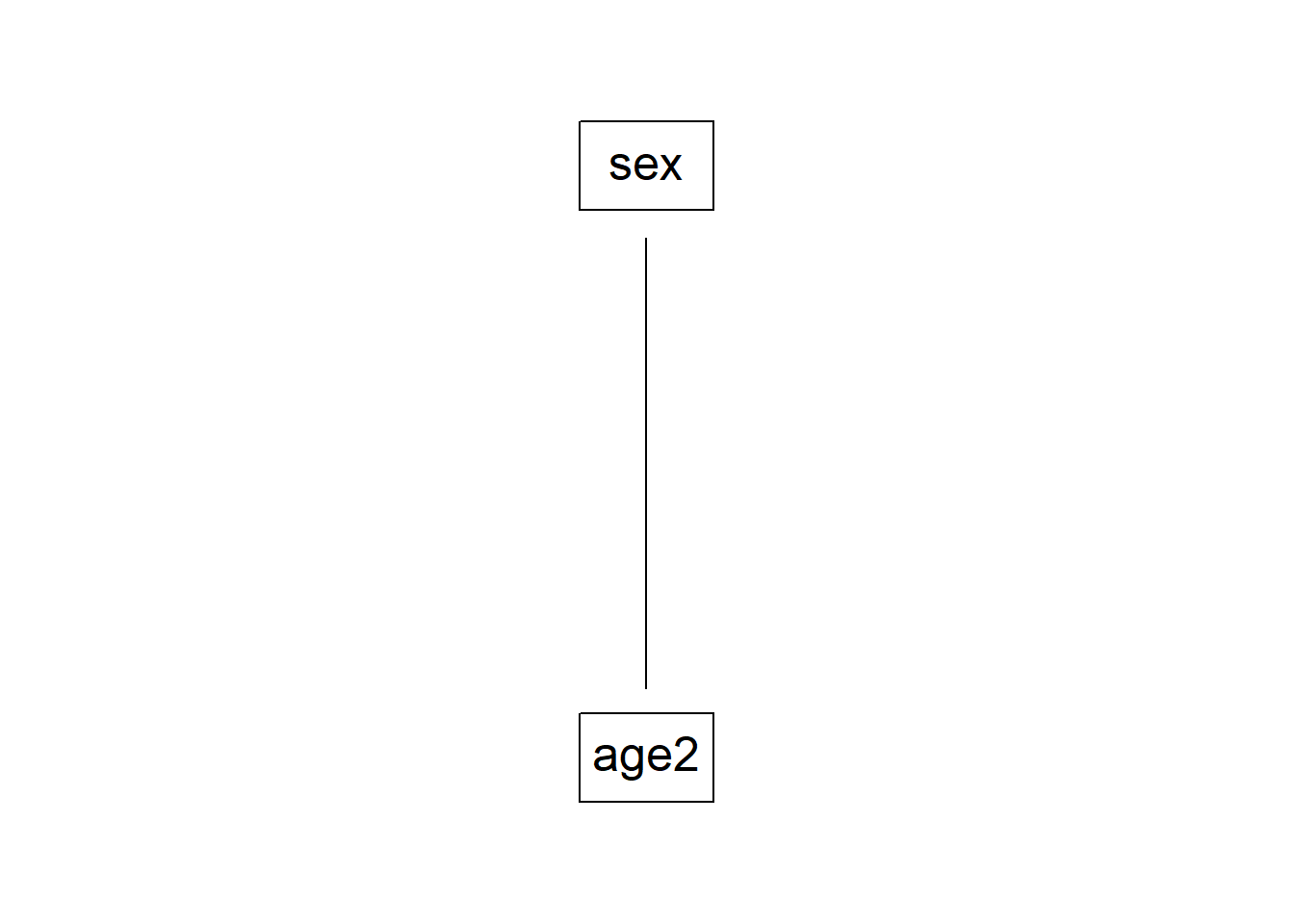

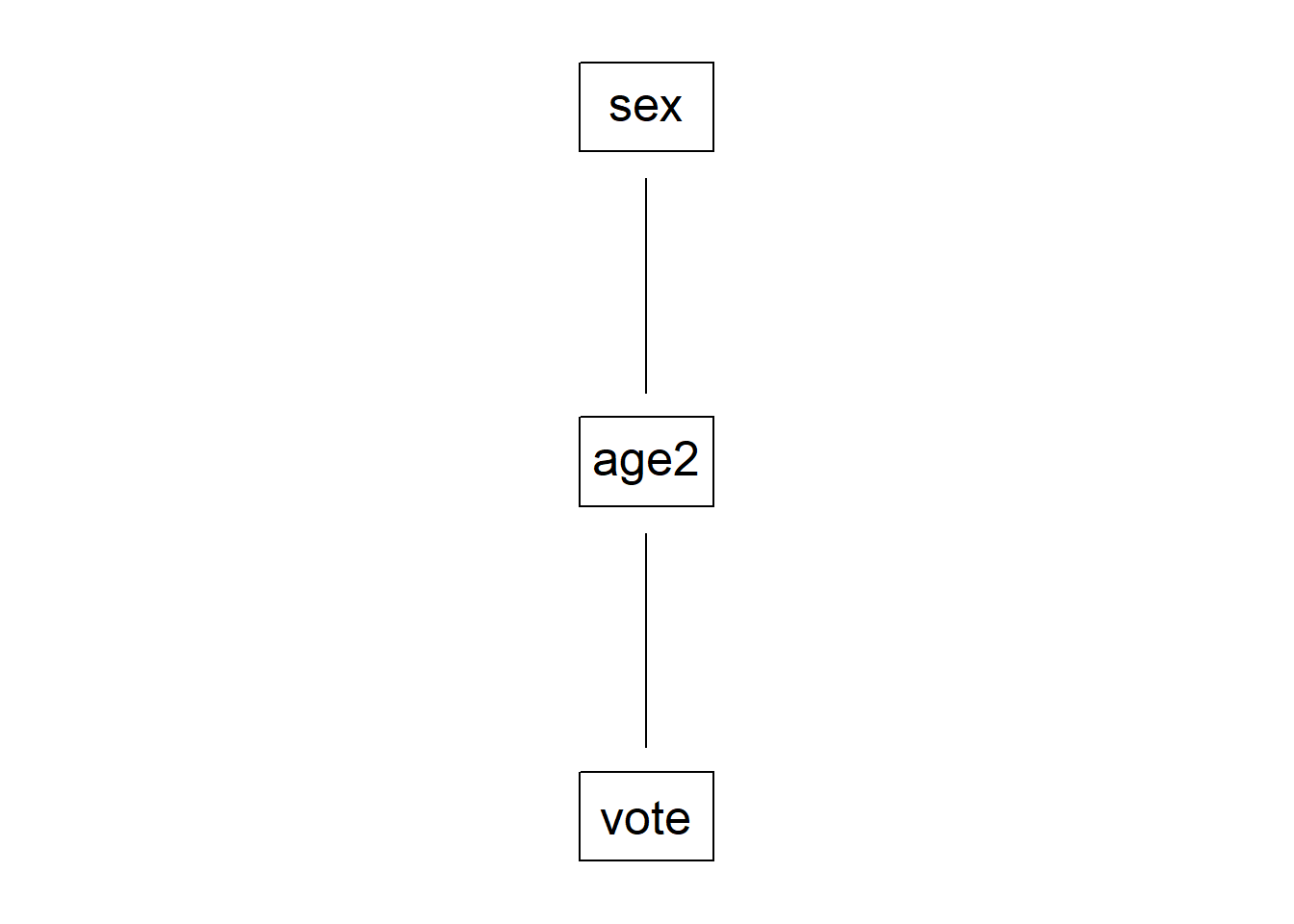

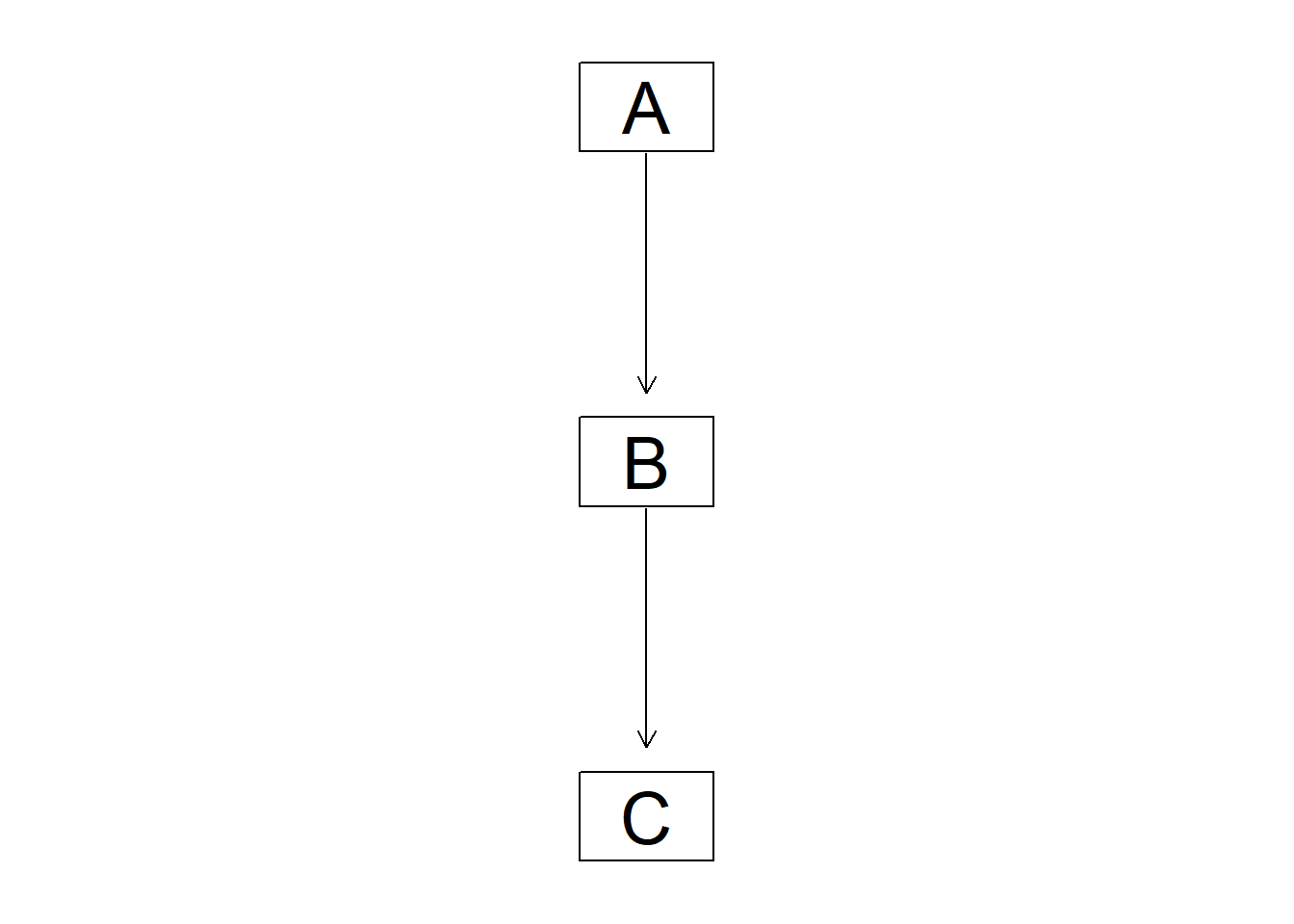

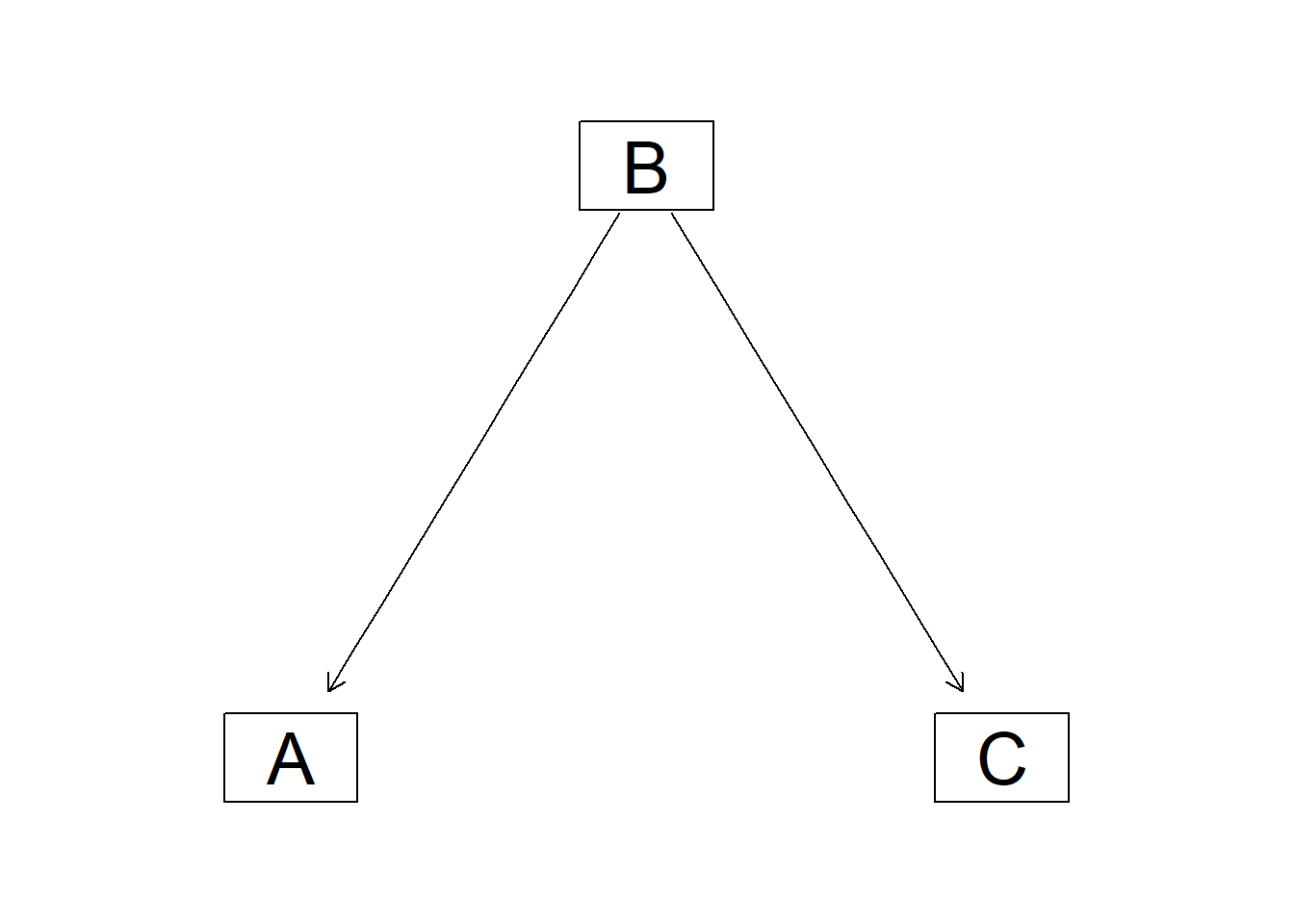

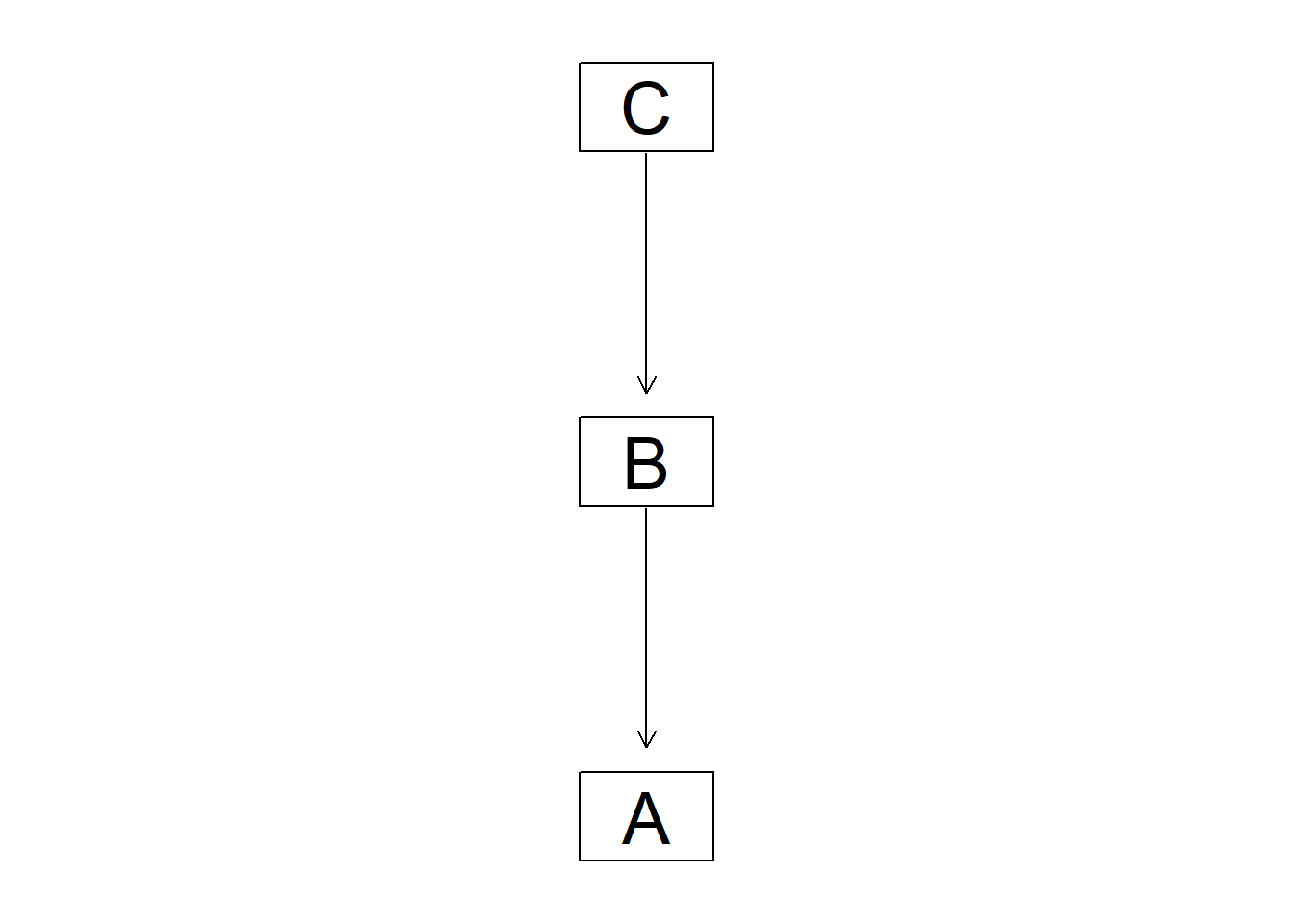

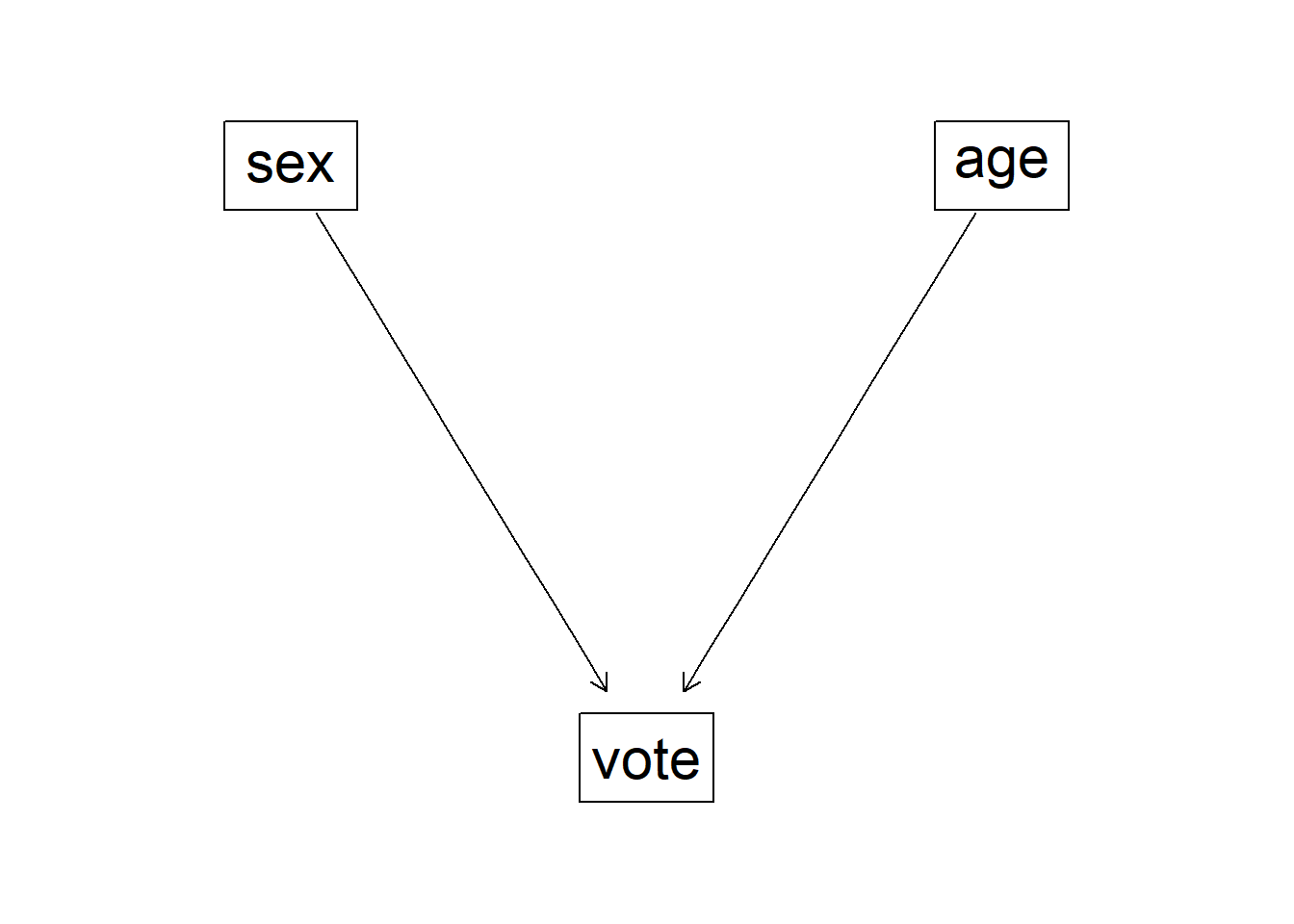

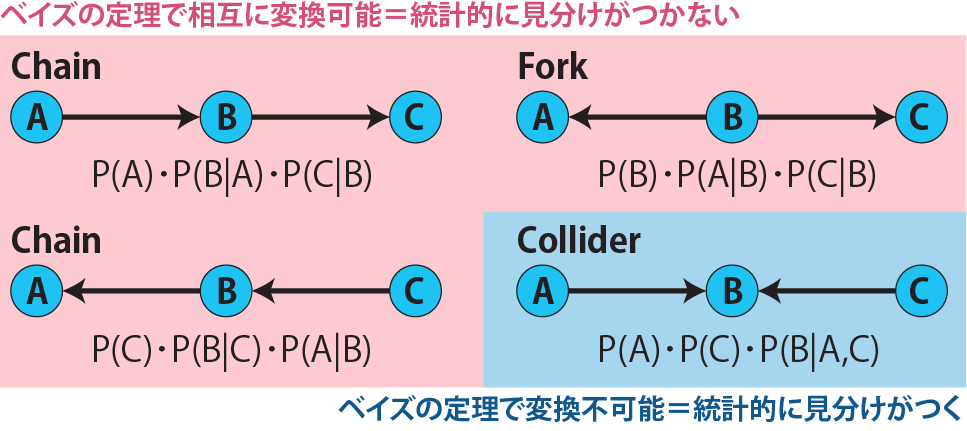

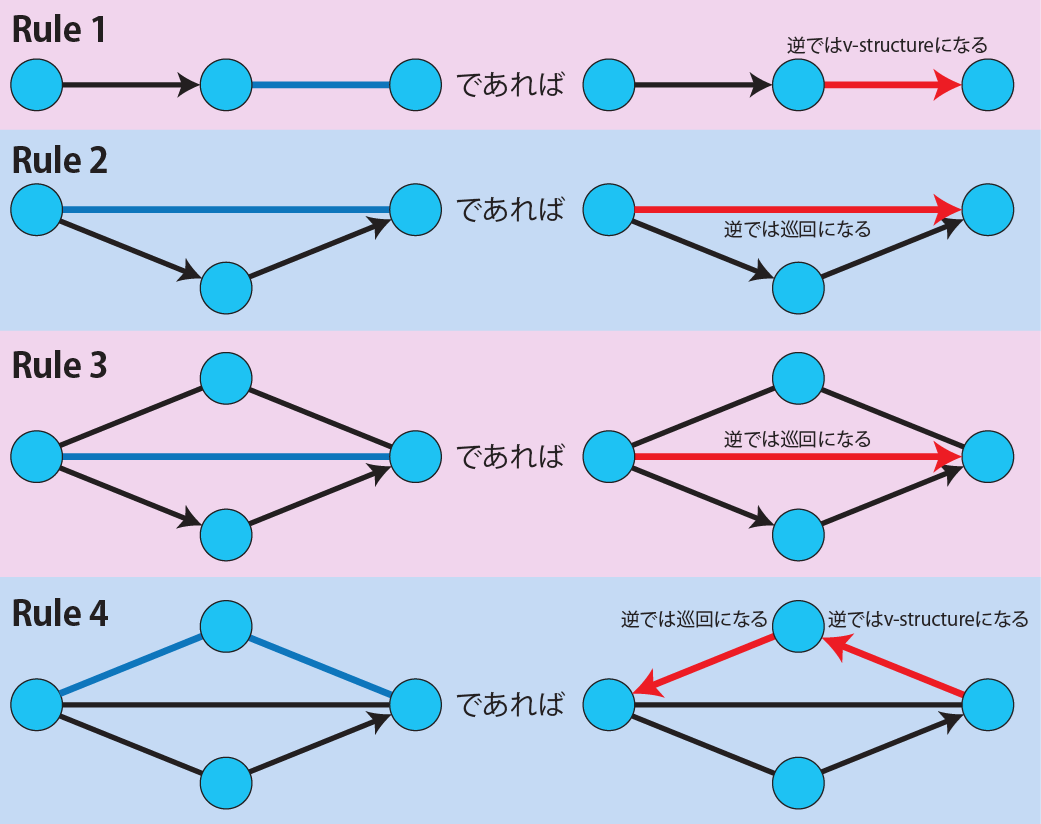

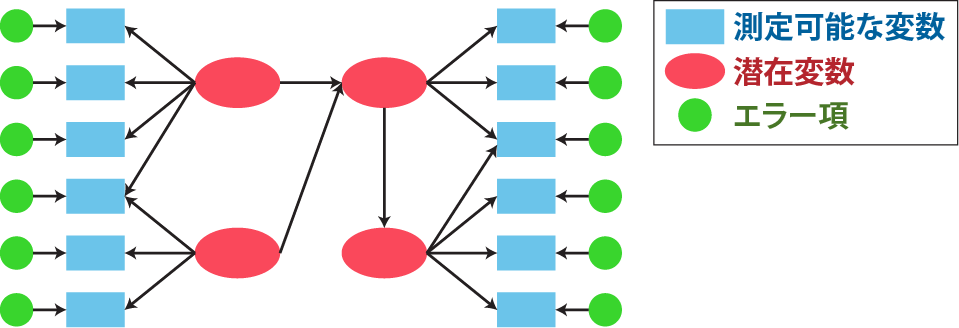

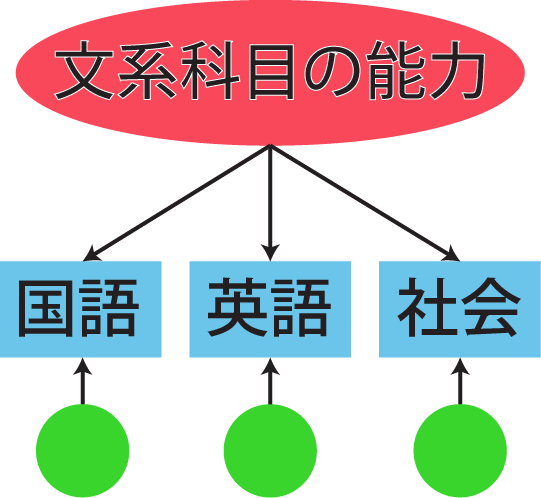

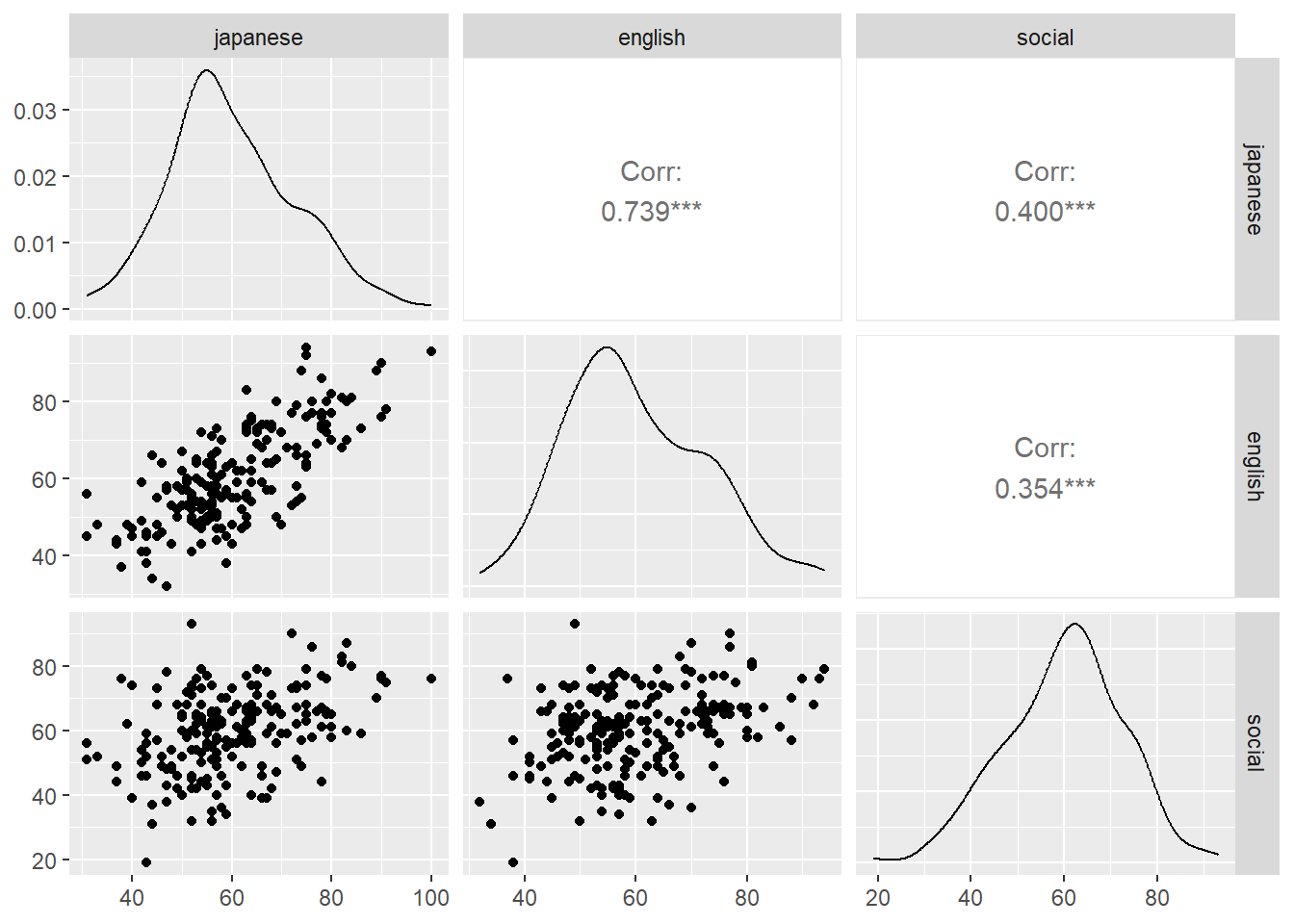

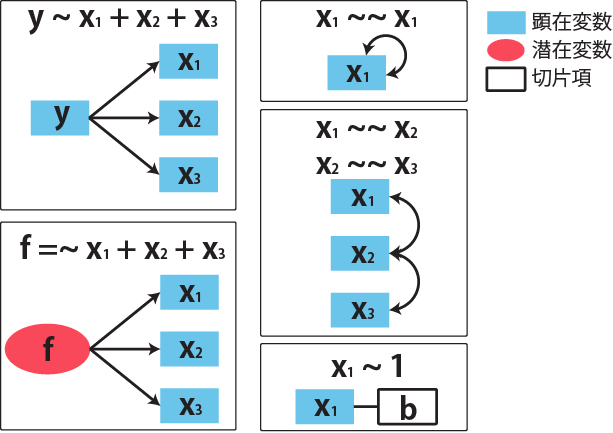

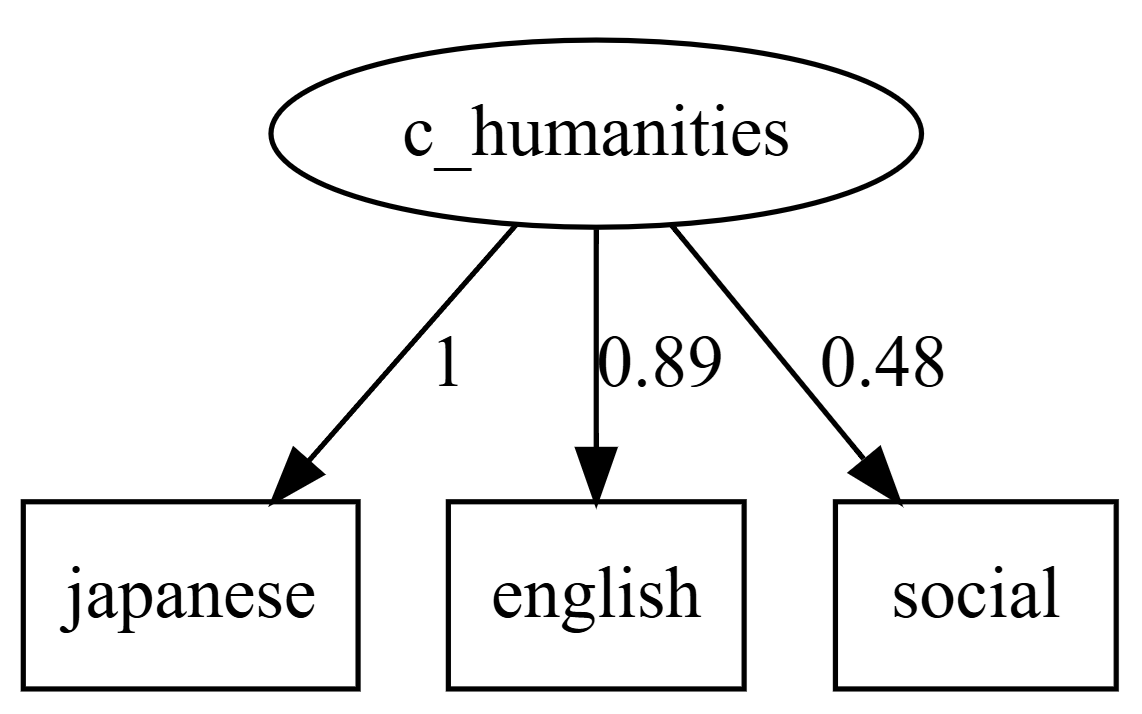

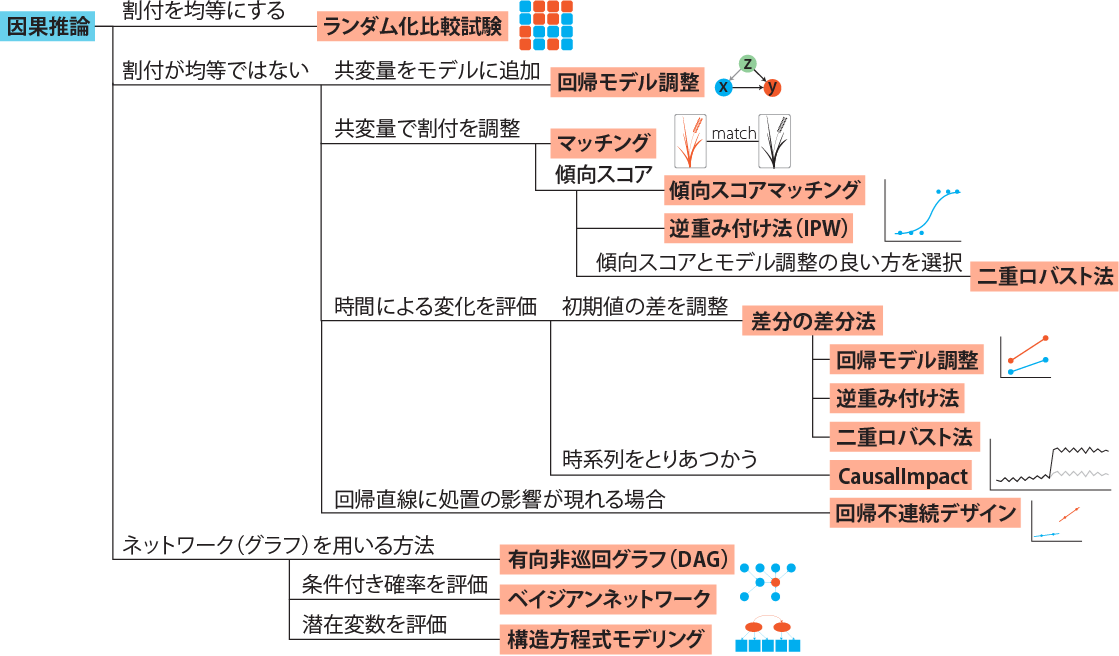

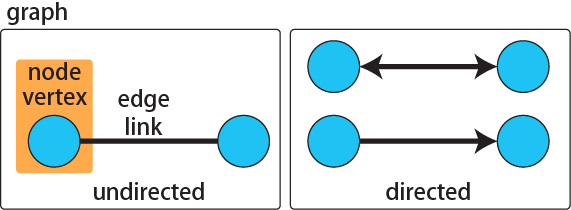

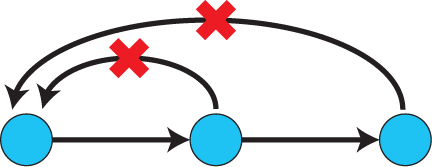

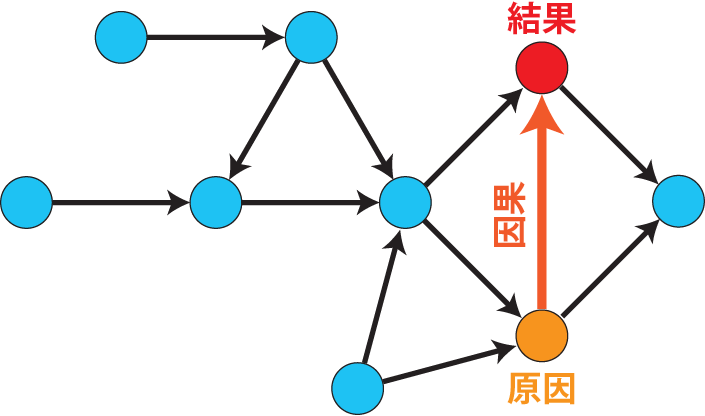

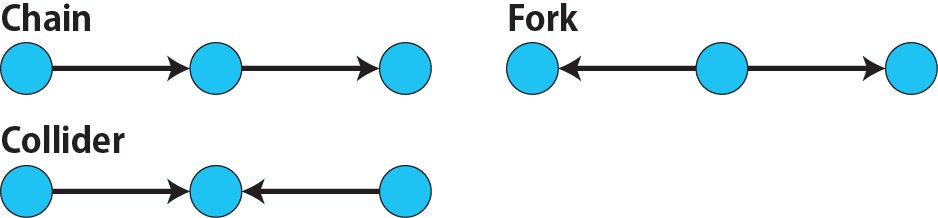

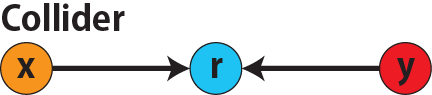

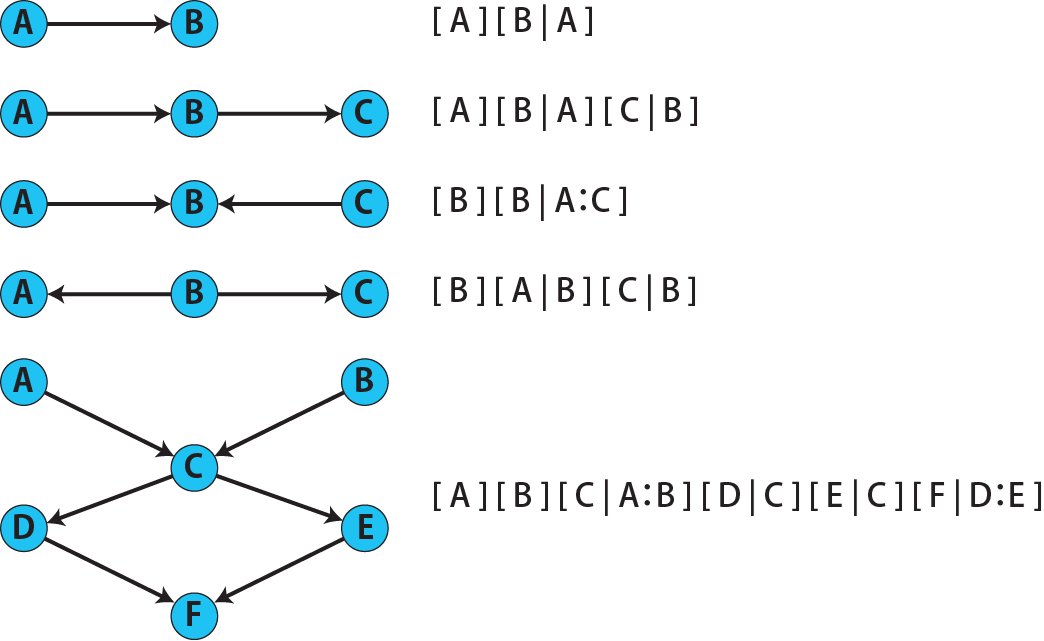

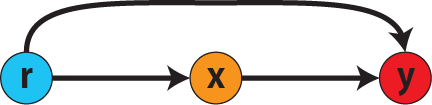

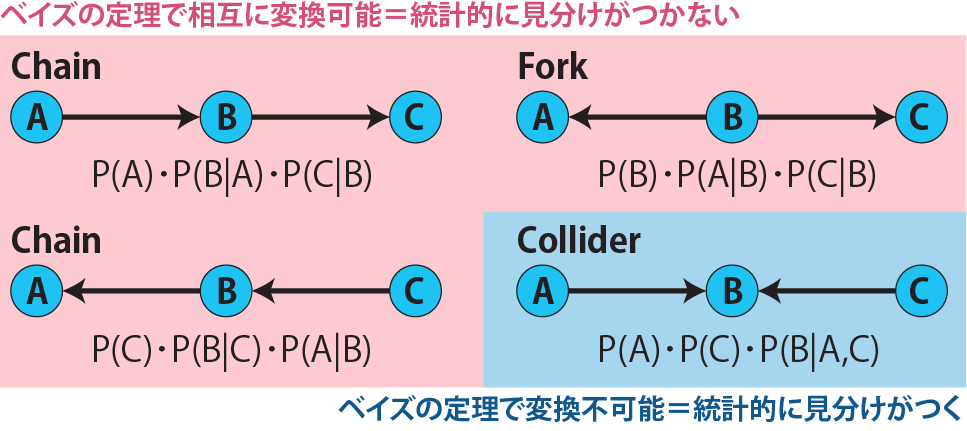

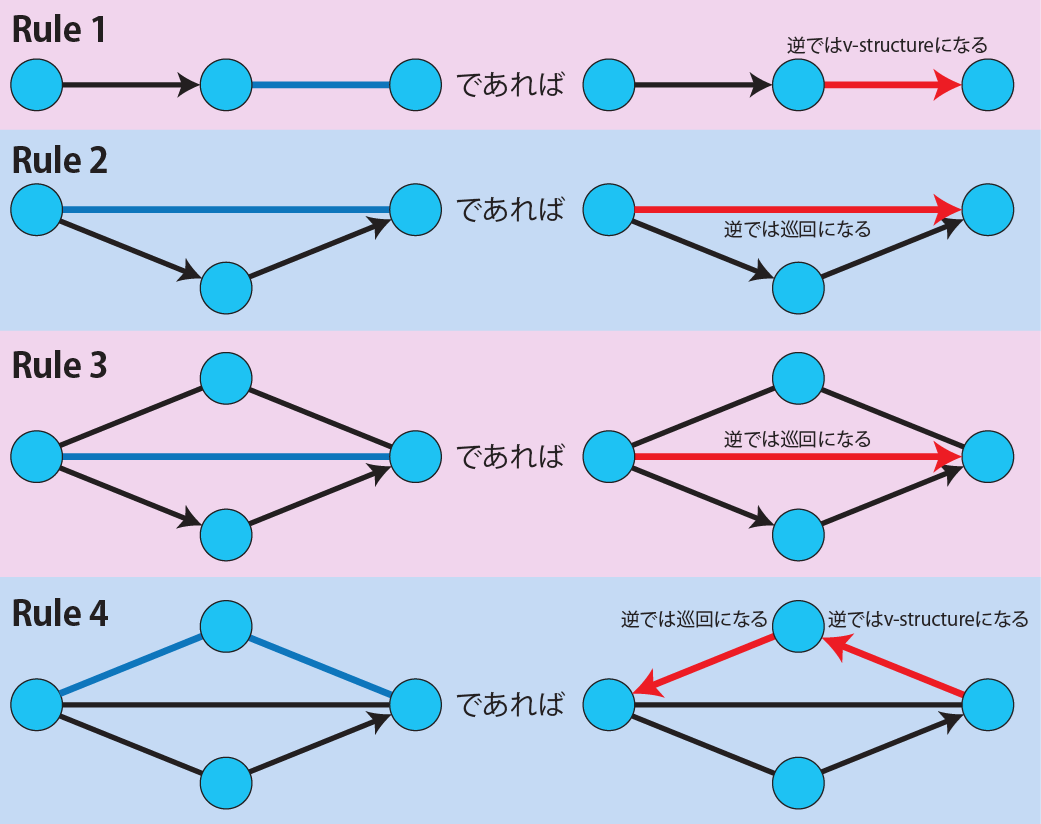

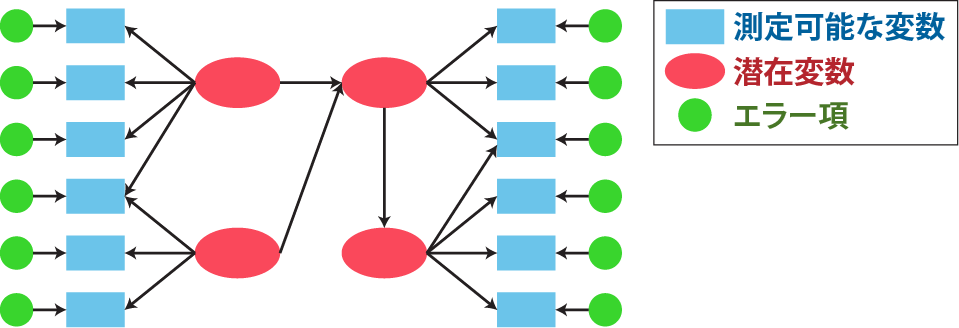

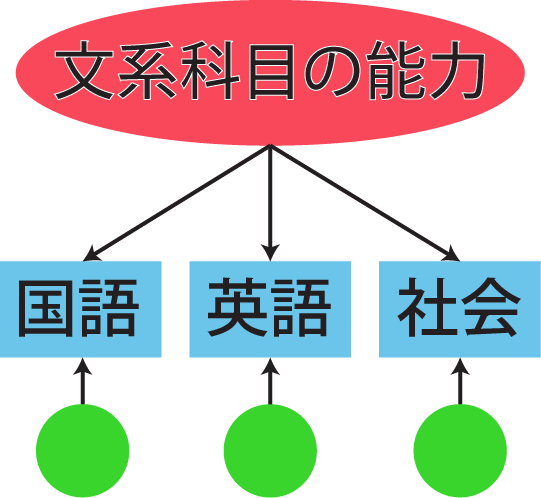

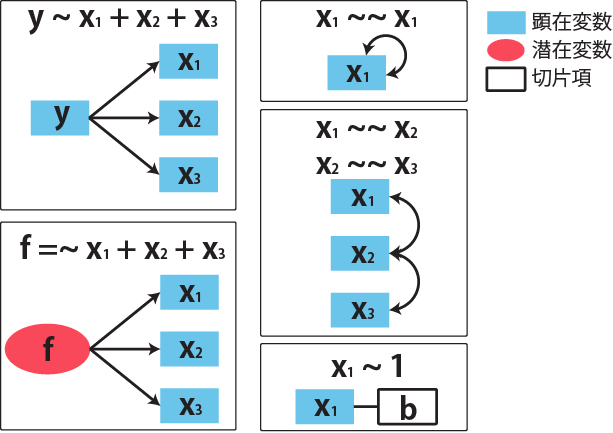

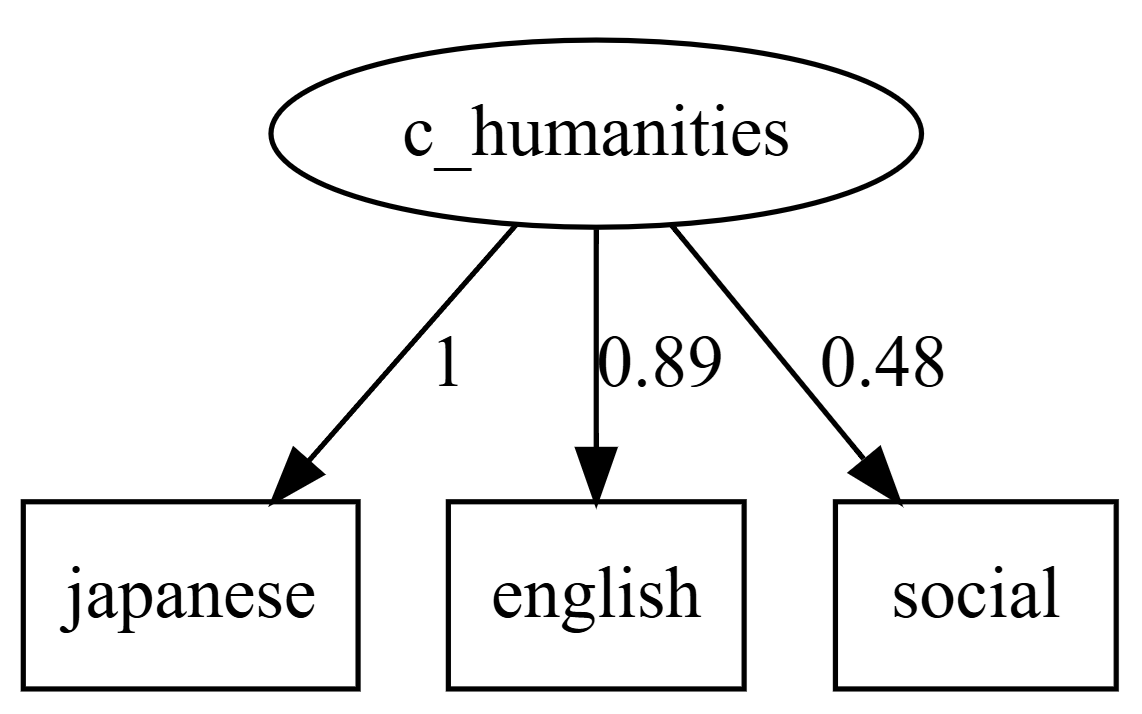

# 因果推論:因果のネットワーク ```{r, echo=FALSE, message=FALSE, warnings=FALSE} library (tidyverse)set.seed (0 )```  ## 有向非巡回グラフ(Directed Acyclic Graph、DAG) [ 49章 ](chapter49.qmd) や[ 50章 ](chapter50.qmd) で述べてきた通り、説明変数(処置)と目的変数(結果)の因果関係を評価する場合、因果関係に関与しうる共変量や交絡を回帰で調整したり、処置(割付)に影響を及ぼす共変量を傾向スコアなどの手法で調整することが特に観察研究では重要となります。[ 46章 ](chapter46.qmd) で説明したネットワークの一種で、いくつかのルールを定めて、共変量、説明変数、目的変数の間に想定される因果関係をネットワーク(グラフ)として表記したものです。  ### DAG:調整に関わるedgeの種類  {width=500}- **Chain(連鎖)**:因果関係が連続するnode- **Fork(共通原因)**:因果関係が双方に向かうnode- **Collider(共通結果)**:因果関係が集中するnode #### DAG:Chain(連鎖)  `x` と目的変数`y` の関係を評価する場合、共変量`r` で調整する必要はありません。つまり、**Chainにおいて、1つ上流の原因で調整した場合、2つ以上上流の共変量では調整する必要がありません**。`x` は`r` の関数、`y` は`r` の関数で表すことができる状況で、`lm(y~x)` と`lm(y~x+r)` 、`lm(y~x+r+I(r^2))` の3つ、つまり`x` のみの統計モデル(`x_model` )と`x` に`r` を加えたモデル(`xr_model` )、さらに`r` の2乗を加えたモデル(`xr_sq_model` )を比較したものです。いずれのモデルにおいても、`x` の傾き(効果)はほぼ4で、`r` をモデルに加えても加えなくても`x` の効果は正確に評価できていることがわかります。```{r, filename="Chain:統計モデル間の比較"} <- NULL for (i in 1 : 1000 ){<- rnorm (161 )<- seq (0 , 10 , by = 0.0625 ) * r ^ 2 + 0.25 * r + 2 + rnorm (161 , 0 , 1 )# xの傾き(coefficient)は4 <- 4 * x + 10 + rnorm (161 , 0 , 5 )<- rbind (c (x_model = lm (y ~ x) |> _$ coefficients |> _[2 ],xr_model = lm (y ~ x + r) |> _$ coefficients |> _[2 ],xr_sq_model = lm (y ~ x + r + I (r ^ 2 )) |> _$ coefficients |> _[2 ]|> summary ()``` `y` が二項分布する場合についても`lm(y~x)` と`lm(y~x+r)` 、つまり`x` のみの統計モデル(`x_model` )と`x` に`r` を加えたモデル(`xr_model` )を比較してみます。いずれのモデルにおいても、`x` の傾き(効果)はほぼ1で、やはり`r` をモデルに加えても加えなくても`x` の効果を正確に評価できていることがわかります。```{r, warning = FALSE, filename="Chain:統計モデル間の比較(二項分布)"} <- NULL for (i in 1 : 1000 ){<- function (x){1 / (1 + exp (- x))}<- rnorm (161 )<- seq (0 , 10 , by = 0.0625 ) * r + 2 + rnorm (161 , 0 , 1 )<- rbinom (161 , 1 , logis (x))<- rbind (c (x_model = glm (y ~ x, family = binomial) |> _$ coefficients |> _[2 ],xr_model = glm (y ~ x + r, family = binomial) |> _$ coefficients |> _[2 ]|> summary ()``` #### DAG:Fork(共通原因) [ 交絡因子 ](chapter49.qmd#交絡(confounding)) です。 `r` がForkのnode、`x` を原因、`y` を結果とし、`x` と`y` の関係を`x` のみの統計モデル(`x_model` )と`x` に`r` を加えたモデル(`xr_model` )で比較してみます。`x_model` では、真の値(4)から大きく外れる結果が得られる時があるのに対し、`r` を加えたモデルではほぼ常に真の値に近い結果が得られていることがわかります。```{r, warning=FALSE, filename="Fork:統計モデル間の比較"} <- NULL for (i in 1 : 1000 ){<- rnorm (161 )<- seq (0 , 10 , by = 0.0625 ) * r ^ 2 + 0.25 * r + 2 + rnorm (161 , 0 , 1 )<- 4 * x + 10 + 25 * r + rnorm (161 , 0 , 5 )<- rbind (c (x_model = lm (y ~ x) |> _$ coefficients |> _[2 ],xr_model = lm (y ~ x + r) |> _$ coefficients |> _[2 ]|> summary ()``` #### DAG:Collider(共通結果)  `r` がColliderのnode、`x` を原因、`y` を結果とし、`x` と`y` の関係を`x` のみの統計モデル(`x_model` )と`x` に`r` を加えたモデル(`xr_model` )で比較してみます。`x_model` では、概ね真の値(4)を評価できているに対し、`r` を加えたモデルではほぼ真の値を評価できていないことがわかります。```{r, filename="Collider:統計モデル間の比較"} <- NULL for (i in 1 : 1000 ){<- seq (0 , 10 , by = 0.0625 )<- 4 * x + 10 + rnorm (161 , 0 , 5 )<- 5 * x + y + rnorm (161 , 0 , 5 )<- rbind (c (x_model = lm (y ~ x) |> _$ coefficients |> _[2 ],xr_model = lm (y ~ x + r) |> _$ coefficients |> _[2 ]|> summary ()``` ### DAG:dagittyパッケージ [ dagitty ](https://www.dagitty.net/)[ @dagitty_bib ] です。`dagitty` を用いれば、ネットワークを表現する簡単な文字列を準備するだけで簡単にDAGを表示することができ、独立の関係にある共変量や、因果関係を示す際に調整が必要となる共変量をDAGから評価することができます。`dagitty` はRから利用するだけではなく、[ Webアプリケーション ](https://www.dagitty.net/dags.html) としてGUIで利用することもできます。`dagitty` でDAGを作成する場合に用いる関数が`dagitty` 関数です。`dagitty` 関数は引数にDAGのネットワーク構造を指定する文字列を取ります。`dagitty` 関数の引数となる文字列では、`dag{}` というコマンドの`{}` の中にnodeとedgeの関係を表記していくことになります。このnodeとedgeの表記では、`A -> B` という形で表記するとnode Aが原因でnode Bが結果となるedgeを意味することになります。また、forkを表現する場合には、`A <- B -> C` という形で、両側に矢印が向くような文字列を入力します。DAGは「非巡回」ですので、下流から上流への矢印が生じないように注意してDAGを設定していきます。また、そのnode自身にedgeが向かうような「ループ」もDAGでは設定することはできません。`dagitty` 関数は`dag{}` のコマンドを返すだけの関数ですので、この返り値(以下の場合では`g1` )を用いてDAGを表示したり、共変量の関係を調べたりすることになります。```{r, filename="dagitty関数"} library (dagitty)# dagコマンドの記載は37章で説明したGraphvizを基にしている <- dagitty ("dag { cdm <- age -> got distvct -> got tinc -> got any -> got tinc -> cdm hiv2004 -> cdm got -> cdm }" )``` #### dagitty:DAGの表示 `dagitty` 関数の返り値を用いてDAGを表示します。DAGの表示には、`graphLayout` 関数と`plot` 関数を用います。`dagitty` 関数の返り値を`graphLayout` 関数の引数に取った後、さらに`plot` 関数の引数に取る必要があります。```{r, filename="dagitty:graphLayout関数でグラフを表示する"} set.seed (0 )|> graphLayout () |> plot ()``` #### dagitty:共変量間の独立性を求める `impliedConditionalIndependencies` 関数です。`impliedConditionalIndependencies` 関数は`dagitty` 関数の返り値を引数に取ります。`impliedConditionalIndependencies` 関数では、互いに独立の(相関が0で、因果関係がない)共変量AとBの場合には`A _||_ B` という表示が返ってきます。`A _||_ B | C` という形で示されます。この条件付き独立では、「Cが一致する場合、AとBは独立」である、要はCで調整するとAとBが独立であることを意味しています。```{r, filename="impliedConditionalIndependencies関数で共変量の関係を表示する"} |> impliedConditionalIndependencies ()``` ```{r, filename="Chain、Fork、Colliderでの共変量の関係"} # chain dagitty ("dag {A->B->C}" ) |> impliedConditionalIndependencies ()# Fork dagitty ("dag {A<-B->C}" ) |> impliedConditionalIndependencies ()# Collider dagitty ("dag {A->B<-C}" ) |> impliedConditionalIndependencies ()``` #### dagitty:調整すべき共変量を評価する `adjustmentSets` 関数です。`adjustmentSets` 関数の引数には`dagitty` 関数の返り値、処置(説明変数)を指定する`exposure` 引数、結果(目的変数)を指定する`outcome` 引数、共変量の評価のルールに関わる引数である`effect` 引数の4つを指定します。下の例では`effect="direct"` を指定しています。`effect="total"` を指定すると別の評価のルールでの共変量の候補を、`type="all"` を指定すると調整することができる共変量のすべてのセットを表示してくれます。```{r, filename="adjustmentSets関数で共変量の関係を表示する"} # effect = "direct"での結果(" single-door criterion"に従う方法) adjustmentSets (g1, exposure = "got" , outcome = "cdm" , effect = "direct" )# effect = "total", type = "all"での結果("back-door criterion"を改変したもの) adjustmentSets (g1, "got" , "cdm" , type = "all" , effect = "total" )``` ## effect = "direct"とeffect = "total"の違い `adjustmentSets` 関数のヘルプ(`?adjustmentSets` )に記載の通り、`effect = "direct"` では[ @perković2015completegeneralizedadjustmentcriterion ] 、`effect = "total"` では[ @Pearl2009_Causality_models_jp ] (英語の原著は[ @Pearl2009_Causality_models ] )に従い調整すべき共変量を表示します。`adjustmentSets` 関数の結果の信頼性を高めるためには、共変量同士の因果関係を整理し、なるべく正確にDAGを作成することが重要となります。## ベイジアンネットワーク ### ベイジアンネットワーク:確率的な依存関係 `dagitty` などを用いてDAGを作成する場合には、その作成者の知識や経験から「存在すると考えられる因果関係」を記載します。しかし、実際に因果性を評価するとなると、ここまで述べてきたように高いハードル(無作為化、共変量の調整など)があります。 {width=500}`[ ]` で表していますが、これは後ほど説明する`bnlearn` パッケージ[ @bnlearn_bib; @bnlearn_bib2; @bnlearn_bib3; @bnlearn_bib4 ] で用いる表現方法です。`bnlearn` パッケージでは`[B | A:C]` という形で$P(B|A, C)$を表記します。### ベイジアンネットワーク:ネットワーク構造の推定 #### 条件付き独立性の検定 [ $$r \perp y|x$$ ] {style="font-size: 200%;"}  [ $$r \not\perp y|x$$ ] {style="font-size: 200%;"}  #### DAGのスコア [ 30章 ](chapter30.qmd#aicによるモデル選択) で説明したAICでのモデル選択に似たものです。AICによるモデル選択では、AICが最小となるモデルを採用しました。DAGの構造推定でも同様に、AICに当たるようなスコアが最小となる構造をDAGの推定結果とします。### ベイジアンネットワーク:bnlearnパッケージ `bnlearn` パッケージ[ @bnlearn_bib ] です。`bnlearn` パッケージでは、- DAGの構造を推定する- DAGの構造を指定する- 推定・指定したDAGにおける条件付き確率を演算する`bnlearn` には他にもたくさんの機能がありますが、このテキストでは上記の3つについて演算の方法を簡単に紹介します。#### bnlearn:DAGの構造を決定する `bnlearn` パッケージをインストールします。`bnlearn` で作成したDAGを表示するために、[ Bioconductor ](https://www.bioconductor.org/) で提供されている`graph` パッケージと`RgraphViz` パッケージを同時にインストールしておきます。```{r, filename="bnlearnパッケージのインストール"} :: p_load (bnlearn)``` ```{r, eval=FALSE} :: p_load (BiocManager)install (c ("graph" , "Rgraphviz" ))``` `bnlearn` の[ 解析例 ](https://www.bnlearn.com/examples/fit/) に示されているものです。`learning.test` は`bnlearn` に登録されているデータセットで、6列のデータフレームです。各列にはA〜Fの名前がついており、すべての列が因子、つまりカテゴリカルデータとして登録されています。この各列をnodeの変数として用います。```{r, filename="サンプルデータ(learning.test)"} data (learning.test)summary (learning.test)``` ## ベイジアンネットワークに用いるデータ `learning.test` のようなカテゴリカルデータのみのデータ、正規分布する連続変数のみのデータ、カテゴリカルデータと正規分布する連続変数の混じったデータの順に解析が難しくなっていきます。このため、解析例としてまずはカテゴリカルデータのみのデータを用いることが多いようです。教科書などでもカテゴリカルデータのみのデータ、正規分布する連続変数のみのデータ、カテゴリカルデータと正規分布する連続変数の混じったデータの順で解析例が解説されていることがあります。[ Rと事例で学ぶベイジアンネットワーク ](https://www.amazon.co.jp/R%E3%81%A8%E4%BA%8B%E4%BE%8B%E3%81%A7%E5%AD%A6%E3%81%B6%E3%83%99%E3%82%A4%E3%82%B8%E3%82%A2%E3%83%B3%E3%83%8D%E3%83%83%E3%83%88%E3%83%AF%E3%83%BC%E3%82%AF%E3%80%94%E5%8E%9F%E8%91%97%E7%AC%AC2%E7%89%88%E3%80%95-Marco-Scutari/dp/4320114655)[ @1971993809756830770 ] )などを参照ください。`learning.test` のデータを用いてDAGの構造を推定します。DAGの構造の推定には`iamb` 関数を用います。この関数は引数にデータフレームを取り、ネットワーク構造の情報を含む`bn` クラスのオブジェクトを返します。```{r, filename="データからDAGを推定する"} # データからDAGを推定するアルゴリズム(Incremental Association)に対応した関数 # 他のアルゴリズムについてはhttps://www.bnlearn.com/documentation/man/structure.learning.html を参照 <- iamb (learning.test)# 返り値(pdag)のクラスは"bn" class (pdag)# DAG構造の情報が含まれる ``` `iamb` 関数(Incremental Association Algorithmを用いた手法)でDAGの構造を推定しています。`bnlearn` には`iamb` 関数の他、多数の[ 構造決定のアルゴリズム ](https://www.bnlearn.com/documentation/man/structure.learning.html) の関数が準備されています。## 構造決定のアルゴリズムとその種類について `bnlearn` で引用されている[ プレゼンテーション ](https://www.bnlearn.com/about/slides/slides-pgm18.pdf) では、データ数が少ない場合にはConstraint-Basedのアルゴリズムの正確性が高く、Score-Basedのアルゴリズムの演算が速いと記載されています。`bn` オブジェクトに登録されているDAGの構造を表示する場合には、`graphviz.plot` 関数を用います。```{r, filename="データからDAGを推定する", message=FALSE} # 推定したDAGを表示(rgraphvizパッケージを利用) library (Rgraphviz)graphviz.plot (pdag)``` `iamb` 関数などを用いることで、データからDAGの構造を推定することができます。ただし、上記のAとBの間のedgeは矢印とはなっていません。DAGの構造推定では、このように方向が定まらないedgeが生じる場合があります。#### bnlearn:WhitelistとBlacklistを指定する `whitelist` )、edgeを繋がないnode(`blacklist` )をそれぞれ引数に設定することができます。この2つの引数を設定すれば、DAGの構造の推定に解析者が持っている事前の知識を加えて評価することができます。`whitelist` 、`blacklist` 引数にはいずれもデータフレームを指定します。このデータフレームでは、列名が`from` と`to` の2列となるように設定します。```{r, filename="あらかじめ繋ぐ・繋げないnodeを指定する"} <- data.frame (from = "D" , to = "E" ) # D -> Eを設定 <- data.frame (from = "B" , to = "E" ) # B -> Eは設定しない iamb (learning.test, whitelist = white_list, blacklist = black_list) |> graphviz.plot ()``` #### bnlearn:条件付き独立性の検定 `ci.test` です。`ci.test` 関数は個別のnode・edgeの独立性を評価する場合に利用できます。`x` と`y` が独立性を評価する変数を指定する引数、`z` が条件に当たる変数を指定する引数です。`data` 引数にデータフレームを指定し、`x` 、`y` 、`z` の3つには文字列でデータフレームの列名を指定します。`learning.test` データセットの各列の条件付き独立性を評価しており、$E$と$A$は$B$の条件下で独立であり、$E$と$F$は$B$の条件下で独立ではないという結果を得ています。したがって、$A \rightarrow E$のedgeはなく、$F \rightarrow E$のedgeは繋げられている形になります。```{r, filename="bnlearn:条件付き独立性の検定"} # EとAがBの条件下で独立であることを評価する ci.test (x = "E" , y = "A" , z = "B" , data = learning.test) # EとFがBの条件下で独立であることを評価する ci.test (x = "E" , y = "F" , z = "B" , data = learning.test) ``` #### bnlearn:ネットワークのスコア `bnlearn` ではネットワークのスコアを計算し、ネットワーク全体でデータがどの程度正確に評価できているのかを評価することができます。このスコアとして、ベイジアンネットワークでは**BIC(bayesian information criteria)**を用いるのが一般的です。BICは30章で説明した[ AIC ](Chapter30.qmd#aicによるモデル選択) と同じく尤度とパラメータの数からなる指標で、より小さいBICを持つDAGでは、よりうまくデータを説明できているとする指標となります。`score` 関数です。`score` 関数はDAGを示す変数`x` と各nodeに当たる変数のデータ`data` の2つを引数に取り、ネットワークのスコアを数値で返す関数です。ただし、このスコアは-2で割られているため、スコアが小さいものではなく、**スコアが大きいほどデータをうまく説明できるDAG**になっています。```{r, filename="ネットワークのスコアを計算する:score関数"} score (pdag, data = learning.test)``` `iamb` 関数で推定したDAGと、`iamb` 関数に`whitelist` と`blacklist` を指定して推定したDAG、私が適当に作ったDAGの3つのスコアを比較しています。`iamb` 関数で推定したDAGのスコアが最も大きく、データを最もうまく説明できていることがわかります。```{r, filename="DAGのスコアを比較する:比較するDAGを準備する"} <- iamb (learning.test)<- set.arc (pdag, from = "A" , to = "B" )<- iamb (learning.test, whitelist = white_list, blacklist = black_list)<- set.arc (pdag2, from = "A" , to = "B" )<- model2network ("[A][B][C|A:B][D|C][E|C][F|C:D:E]" )``` ```{r} #| layout-ncol: 3 #| code-fold: true |> bnlearn:: graphviz.plot (main = "iambで推定したDAG" )|> bnlearn:: graphviz.plot (main = "whitelist・blacklistを指定したDAG" )|> bnlearn:: graphviz.plot (main = "適当な構造のDAG" )``` ```{r, filename="DAGのスコアを比較する"} c (score (pdag, learning.test),score (pdag2, learning.test),score (pdag3, learning.test)``` `type` 引数を指定することで、BIC、AIC、BDE(Bayesian Dirichlet equivalent score)を計算しています。`bnlearn` ではこの3つの他にも数多くの演算方法でDAGのスコアを評価することができます。`bnlearn` で計算できるスコアの種類については[ `bnlearn`のスコア計算の例 ](https://www.bnlearn.com/documentation/man/network.scores.html) を参照して下さい。```{r, filename="様々なスコア計算の手法"} score (pdag, learning.test, type = "bic" ) # BIC score (pdag, learning.test, type = "aic" ) # AIC score (pdag, learning.test, type = "bde" ) # Bayesian Dirichlet equivalent score (BDE) ``` `by.node=TRUE` を指定すると、各ノードごとのスコアを計算することができます。この各ノードのスコアを足し合わせるとDAG全体のスコアと同じになります。```{r, filename="各ノードのスコアを計算する"} score (pdag, learning.test, by.node = TRUE )# 足し合わせると上記のBICのスコアと一致する score (pdag, learning.test, by.node = TRUE ) |> sum () ``` #### bnlearn:DAGの構造を指定する `bnlearn` では、DAGの構造を推定するだけではなく、後ほどの条件付き確率の演算に用いるためのDAGを作成し、そのDAGを前提として条件付き確率を推定することもできます。[ edge listから作成する方法 ](chapter46.qmd#edge listからグラフを作成する) 、[ adjacency matrixから作成する方法 ](chapter46.qmd#adjacency matrixからグラフを作成する) の他に、上で少し説明した`[B | A:C]` という形の条件付き確率の積でDAGを指定する方法の主に3つを用いることができます。この3つの方法について、簡単に説明していきます。##### edge listから作成する方法 `empty.graph` 関数で作成します。`empty.graph` は文字列のベクターを引数に取り、そのベクターの要素がnodeとなるようなedgeなしのグラフを返します。```{r, filename="空のグラフを作成する", fig.height=2} = empty.graph (LETTERS[1 : 6 ])|> graphviz.plot ()``` [ 46章 ](chapter46.qmd#edge listからグラフを作成する) で説明したものと全く同じです。1列目にfrom、2列目にtoとなるnodeを指定し、fromからtoに向かうedgeを表現します。```{r, filename="edge listを作成する"} <- matrix (c ("A" , "B" , # A->Bのedgeを指定 "B" , "C" , "A" , "C" , "C" , "D" ,"D" , "E" ,"E" , "F" ,"D" , "F" ncol = 2 ,byrow= TRUE # byrow引数を設定するとわかりやすい colnames (el) <- c ("from" , "to" )``` `arcs` 関数を用いて空のグラフにedge listを設定します。`arcs` 関数は上で作成した空のグラフや、edge listに指定したのと同じnodeが設定されたグラフを引数に取ります。この`arcs` 関数にedge listを代入することで、edge listに従ったedgeを作成することができます。```{r, filename="edge listを設定する"} arcs (e) <- el|> graphviz.plot ()``` ##### adjacency matrixから作成する方法 [ 46章 ](chapter46.qmd#adjacency matrixからグラフを作成する) で説明しています。adjacency matrixは、行方向にfrom、列方向にtoのnodeを指定し、値が1であればedgeあり、0であればedgeなしを意味するような行列のことです。```{r, filename="adjacency matrixを作成する"} # 対角成分より下はすべて0でないといけない <- matrix (c (0 , 1 , 0 , 1 , 0 , 0 , 0 , 0 , 1 , 0 , 1 , 0 , 0 , 0 , 0 , 1 , 0 , 0 , 0 , 0 , 0 , 0 , 1 , 1 , 0 , 0 , 0 , 0 , 0 , 1 , 0 , 0 , 0 , 0 , 0 , 0 ncol = 6 ,byrow= TRUE colnames (ajm) <- LETTERS[1 : 6 ]rownames (ajm) <- LETTERS[1 : 6 ]# A行B列の1が、A->Bを意味する ``` `amat` 関数の引数に取り、`amat` 関数にadjacency matrixを代入することでedgeを指定することができます。```{r, filename="adjacency matrixでedgeを指定する"} amat (e) <- ajm|> graphviz.plot ()``` ##### 条件付き確率の積から作成する方法 `bnlearn` パッケージでは、この条件付き確率の積を文字列で表現したmodel stringというものを用います。model stringは以下のように、`bn` のオブジェクトを`modelstring` 関数の引数に取ることで表示させることができます。```{r, filename="model stringを表示する"} modelstring (e)``` `"[D|A:C]"` という形で記載します。この`"[D|A:C]"` では、$A \rightarrow D$、$C \rightarrow D$の2つのedgeが存在することを示しています。`model2network` 関数です。`model2network` 関数は文字列のmodel stringを引数に取ります。```{r, filename="model2networkでmodel stringからDAGを作成する"} model2network ("[A][B][C|A:B][D|C][E|C][F|C:D:E]" ) |> graphviz.plot ()``` #### bnlearn:条件付き確率の評価 `bnlearn` では、DAGの構造を推定、もしくは指定した後、上記の条件付き確率を評価することができます。`bn.fit` 関数を用います。`bn.fit` 関数は`score` 関数と同様に、第一引数にDAGの構造を推定/指定した`bn` オブジェクト、第二引数に結果を含むデータフレームを取ります。また、`method` 引数には計算の方法を指定します。以下の例では、`method="mle"` 、最尤法で確率の計算を行います。```{r, filename="条件付き確率の推定"} # pdag2dag:方向が無いedgeの方向を定める関数 = pdag2dag (pdag, ordering = c ("A" , "B" , "C" , "D" , "E" , "F" ))<- bn.fit (dag, learning.test, method = "mle" )``` `bn.fit` 関数の返り値には、それそれのnodeに当たる変数における条件付き確率の計算結果が含まれています。以下では、変数のうちDに関する条件付き確率のみ表示しています。Dに関する条件付き確率は条件をCとした時、つまりDAGにおけるDの上流のnodeを条件とした確率として表示されます。```{r, filename="推定結果の表示:ノードD"} # Cの条件付き確率として表示される $ D``` ##### 演算した条件付き確率の表示 `bn.fit` 関数の返り値として表示させることができます。しかし、数値のみを見てDAGの構造と条件付き確率の関係を捉えるのは難しいです。`bnlearn` では、グラフ作成パッケージである`lattice` [ @lattice_bib ] を用いてグラフの構造と条件付き確率を視覚的に捉えやすくするための関数をいくつか備えています。`bn.fit.barchart` 関数から紹介します。`bn.fit.barchart` 関数は`bn.fit` 関数で計算した条件付き確率を`lattice` の棒グラフで示してくれる関数です。棒グラフの上に記載されている変数が条件付き確率の条件、グラフは条件付き確率をそれぞれ示したものとなります。```{r, filename="推定結果の表示:latticeで棒グラフを表示する"} $ D |> bn.fit.barchart ()``` `graphviz.chart` 関数は上記の`bn.fit.barchart` 関数と同様の条件付き確率に関する棒グラフをネットワークの構造を反映させた上で描画してくれる関数です。```{r, fig.height = 7, filename="推定結果の表示:graphviz.chart関数"} :: p_load ("gRain" )graphviz.chart (fit, scale= c (1.1 , 2 ))``` `bn.fit` 関数の結果である条件付き確率だけではネットワーク上のnode間の関係を捉えるのは難しいですが、`bn.fit.barchart` や`graphviz.chart` を駆使することで関係を視覚的に捉えることができます。### bnlearn:その他の機能について `bnlearn` の機能の基礎について簡単に述べてきましたが、上に紹介した手法は`bnlearn` のほんの一部について紹介したに過ぎません。`bnlearn` には、さらに以下のような演算に関する機能が備わっています。`bnlearn` の機能を学びたい場合には、[ 文献 ](references.qmd#因果推論) を参考にして下さい。## 条件付き確率とDAG ### 独立 {.unnumbered} ```{r, filename="年齢と性別が独立の場合の例"} set.seed (0 )<- sample (rep (c ("male" , "female" ), 5000 ),10000 , replace = FALSE |> factor ()<- sample (rep (c ("under49" , "over50" ), c (4000 , 6000 )),10000 , replace = FALSE |> factor ()table (data.frame (sex, age))``` ```{r, filename="性別と年齢が独立の場合のグラフ", fig.height=2} data.frame (sex, age) |> iamb () |> graphviz.plot ()``` ### 2変量が独立ではない場合 {.unnumbered} ```{r, filename="性別と年齢が独立ではない場合の例"} <- if_else (== "male" ,sample (rep (c ("under49" , "over50" ), c (6000 , 4000 ))),sample (rep (c ("under49" , "over50" ), c (4000 , 6000 ))),|> factor ()table (data.frame (sex, age2))``` [ カイ二乗検定の独立性の検定 ](chapter29.qmd#適合性の検定と独立性の検定) を用います。独立性の検定では、帰無仮説は「2つの変量は独立である」とします。性別と年齢をカイ二乗検定で評価すると、p値が0.05以下となり帰無仮説が棄却され、性別と年齢は独立ではないことがわかります。```{r, filename="カイ二乗検定で独立性を評価する"} chisq.test (table (data.frame (sex, age2)))``` `bnlearn` でedgeをつないだときの以下の式と同じになります。```{r, filename="性別と年齢が独立ではない場合のグラフ"} data.frame (sex, age2) |> iamb () |> graphviz.plot ()``` ### 条件付き独立性の検定とedge {.unnumbered} ```{r, filename="Chainの条件付き確率の例"} <- if_else (== "over50" ,sample (rep (c ("Republican" , "Democratic" ), c (7000 , 3000 ))),sample (rep (c ("Republican" , "Democratic" ), c (3000 , 7000 ))),|> factor ()table (data.frame (sex, age2, vote))``` ```{r, filename="年齢と性別・年齢と投票先の条件付き独立の検定"} ci.test (x = "age2" , y = "sex" , z = "vote" , data = data.frame (sex, age2, vote))ci.test (x = "age2" , y = "vote" , z = "sex" , data = data.frame (sex, age2, vote))``` ```{r, filename="投票先と性別の条件付き独立の検定"} ci.test (x = "vote" , y = "sex" , z = "age2" , data = data.frame (sex, age2, vote))``` ```{r, filename="Chainのグラフを作成する"} data.frame (sex, age2, vote) |> iamb () |> graphviz.plot ()``` #### edgeの方向を決定する {.unnumbered} ```{r, filename="P(A)P(B|A)P(C|B)のグラフ"} model2network ("[A][B|A][C|B]" ) |> graphviz.plot ()``` ```{r, filename="P(B)P(A|B)P(C|B)のグラフ"} model2network ("[B][A|B][C|B]" ) |> graphviz.plot ()``` ```{r, filename="P(C)P(B|C)P(A|B)のグラフ"} model2network ("[C][B|C][A|B]" ) |> graphviz.plot ()``` ```{r, filename="colliderのデータを作成する"} <- data.frame (sex, age) |> mutate (sg = case_when (== "male" & age == "under49" ~ 1 ,== "female" & age == "under49" ~ 2 ,== "male" & age == "over50" ~ 3 ,== "female" & age == "over50" ~ 4 ,<- d$ sg |> factor () |> table ()$ sg[d$ sg == 1 ] <- rbinom (v[1 ], 1 , 0.7 )$ sg[d$ sg == 2 ] <- rbinom (v[2 ], 1 , 0.4 )$ sg[d$ sg == 3 ] <- rbinom (v[3 ], 1 , 0.8 )$ sg[d$ sg == 4 ] <- rbinom (v[4 ], 1 , 0.5 )$ vote <- if_else (d$ sg == 1 , "Republican" , "Democratic" ) |> factor ()$ sg <- NULL |> select (vote, age, sex) |> table ()``` ```{r, filename="Colliderの場合のDAGの推定結果"} |> select (sex, age, vote) |> iamb () |> graphviz.plot ()``` `iamb` 関数でDAGの構造を推定すると方向が決まったedgeが表示されます。全体の確率は、上の例と同様に一般化すると、以下のような式で表すことができます。[ edgeの方向を決める時に重要である ](https://ftp.cs.ucla.edu/tech-report/1991-reports/910020.pdf) とされています[ @verma2022equivalence ] 。 ### v-structure以外のedgeの方向を決める {.unnumbered} [ @meek1995complete ] 。このMeek's ruleという名前は文献に示したレポートの著者から来ていますが、元々は[ こちらの論文 ](https://arxiv.org/pdf/1303.5435)[ @verma1992algorithm ] に記載されていたルールになります。 ### 方向が決まらない場合のbn.fitの演算 {.unnumbered} `bn.fit` 関数の引数に取ると、エラーが出て結果が表示されません。```{r, error=TRUE, message=FALSE, warning=FALSE, filename="方向が決まらないedgeを含むとエラーが出る"} bn.fit (data.frame (sex, age, vote) |> iamb () , data.frame (sex, age, vote), method = "mle" )``` `bn.fit` 関数の引数にPDAGを指定したい場合には、あらかじめedgeの方向をすべて定めておく必要があります。```{r, filename="edgeの方向を定めると演算できる"} bn.fit (data.frame (sex, age, vote) |> iamb (whitelist = data.frame (from = c ("sex" , "age" ), to = c ("age" , "vote" ))) , data.frame (sex, age, vote),method = "mle" )``` ## 構造方程式モデリング(Structural equation modeling) [ @dragonball_17_bib ] とは評価できません。[ 32章で説明した因子分析 ](chapter32.qmd#因子分析) があります。因子分析の例では、学校の成績から「理系度」・「文系度」を評価する例を挙げましたが、「理系度」・「文系度」が潜在変数、学校の成績が測定可能な変数に当たります。構造方程式モデリングはこの因子分析に線形回帰を持ち込んだような統計手法となっています。### 構造方程式モデリング:ネットワーク  ### 構造方程式モデリングの演算 `var` 関数の引数に取ると共分散行列を計算することができます。```{r, filename="共分散行列の演算"} # cov関数でも同じものが求まる var (iris[, 1 : 4 ]) ``` ## 構造方程式モデリングにおける共分散行列の演算 [ 共分散構造分析: 構造方程式モデリング (入門編) ](https://www.amazon.co.jp/dp/4254126581)[ @kyobunnsannkouzoukaiseki_kiso_bib ] 、[ 共分散構造分析: 構造方程式モデリング (R編) ](https://www.amazon.co.jp/dp/4489021801)[ @kyobunnsannkouzoukaiseki_R_bib ] や[ 神戸大学経済学部の分寺先生の講義資料 ](https://www2.kobe-u.ac.jp/~bunji/files/lecture/MVA/html/) に詳しく記載されています。ここでは計算の初歩だけを説明しますので、より詳しくは上記の資料をご参照ください。 {width=300}```{r, filename="テストの成績のデータ"} #| code-fold: true set.seed (0 )<- rnorm (200 , 0 , 1 )<- (motivation_to_learn * 18 + rnorm (200 , 50 , 10 )) |> round (1 )<- (motivation_to_learn * 6000 + rnorm (200 , 10000 , 20 )) |> round (- 2 )<- motivation_to_learn * 0.5 + rnorm (200 , 0 , 0.3 ) # cはconstructのc <- motivation_to_learn * 0.7 + rnorm (200 , 0 , 0.5 )<- c_humanities * 0.8 + rnorm (200 , 0 , 0.2 )<- c_humanities * 0.65 + rnorm (200 , 0 , 0.3 )<- c_humanities * 0.5 + c_science * 0.2 + rnorm (200 , 0 , 0.7 )<- c_science * 0.75 + rnorm (200 , 0 , 0.3 )<- c_science * 0.9 + rnorm (200 , 0 , 0.6 )<- data.frame (motivation_to_learn, c_humanities, c_science, japanese, english, social, science, math, time_learning, payment_for_textbooks) |> scale () |> as.data.frame ()<- d |> select (japanese, english, social, science, math)<- function (x){round (x * 12.5 + 60 )}<- d_indicator |> mutate_all (f)<- cbind (d_indicator, time_learning, payment_for_textbooks)<- d_indicator |> select (japanese, english, social):: kable (d_indicator_simple |> head (), col.names = c ("国語" , "英語" , "社会" ), caption = "10人分を表示" )``` `scale` 関数で正規化します。正規化すると各科目のデータは平均0、分散1に変換されます。```{r, filename="データを正規化する"} <- d_indicator_simple |> scale ()|> as_tibble () |> pivot_longer (1 : 3 ) |> group_by (name) |> summarise (mean_score = mean (value) |> round (2 ), sd_score = sd (value))``` `var` 関数を用いて共分散行列を計算します。```{r, filename="顕在変数の共分散行列"} var (d_indicator_simple_scaled)``` `f` と各科目の成績`x` の因果関係は以下のような式で表すことができます。\\ \\ \\ \\ \\ `var` 関数で示した共分散行列と同じものですので、等式で結ぶことができます。\\ \\ \\ 0.729 & 1 & 0.372 \\ 0.446 & 0.372 & 1\end{pmatrix}$$### lavaanパッケージ `lavaan` パッケージ[ @lavaan_bib1; @lavaan_bib2 ] です。`lavaan` パッケージではパスモデルを簡単なコードで作成することができ、顕在変数のデータと作成したパスモデルから因子負荷量を演算することができます。以下では、まず簡単なパスモデルを用いて因子負荷量の演算を行い、その後もう少し複雑なモデルについても説明します。```{r, filename="lavaan:用いるデータ", message=FALSE} head (d_indicator_simple):: ggpairs (d_indicator_simple)``` #### lavaan:パスモデルの作成 `lavaan` ではまずパスモデルを作成する必要があります。 `f` と顕在変数、$x_1$~$x_3$の関係を示します。したがって、顕在変数間の回帰は`~` で、潜在変数と顕在変数の関係は`=~` で表すことになります。$x_1 \sim \sim x_1$は$x_1$の分散、$x_1 \sim \sim x_2$は$x_1$と$x_2$の共分散を意味しています。`lavaan` の関数の引数とします。以下の例では、文系教科の能力(`humanities` )を潜在変数、国語(`japanese` )、英語(`english` )、社会(`social` )の点数を顕在変数としたパスモデルを作成しています。```{r, filename="パスモデルの作成"} :: p_load (lavaan)# Rと同じくシャープから始まる行はコメント <- ' # latent variables c_humanities =~ japanese + english + social ' ``` #### lavaan:因子負荷量の演算 `sem` 関数を用います。`sem` 関数は上記で作成したパスモデルと、顕在変数のデータを含むデータフレームを用います。[ 30章 ](chapter30.qmd#データの正規化) で説明した`scale` 関数を用います。`sem` 関数は、パスモデルを第一引数に、正規化したデータを第二引数に取ります。```{r, filename="因子負荷量の演算:sem関数"} <- scale (d_indicator_simple) # データの正規化 <- sem (model = Model_edc_simple, data = d_indicator_simple_scaled)``` `coef` 関数で呼び出すことができます。以下の例では`humaniites` と`japanese` の間の因子負荷量が表示されていませんが、`lavaan` では「始めに指定した顕在変数の因子負荷量を1にする」という制約をつけて演算を行う仕組みになっています。したがって、より複雑なパスモデルを用いた場合にも因子負荷量が1になるものが必ず現れます。```{r, filename="因子負荷量の演算結果:coef関数"} coef (fit_edc_simple)``` `predict` 関数で呼び出すことができます。```{r, filename="潜在変数の推定結果:predict関数"} predict (fit_edc_simple) |> head () # 6つだけ表示。クラスは行列 ``` #### パスモデルを表示する:lavaanPlot関数 `lavaanPlot` パッケージです。このパッケージで提供されている`lavaanPlot` 関数は上記の`lavaan` の`sem` 関数の演算結果を引数に取り、使用したパスモデルと因子負荷量を同時に表示してくれます。```{r, filename="lavaanPlot関数でパスモデルと因子負荷量を表示する", eval=FALSE} :: lavaanPlot (model = fit_edc_simple, coefs = TRUE ) # coefs=Tを指定しないと因子負荷量が表示されない ```  {width=500}#### より複雑なパスモデルでの演算 `math` )と理科(`science` )のテストの結果、その学生の学習時間(`time_learning` )と教科書の購入額(`payment_for_textbook` )のデータがあるとします。また、文系科目の能力(`c_humanities` )に加えて理系科目の能力(`c_science` )と学習意欲(`motivation_to_learn` )を潜在変数として評価することとします。```{r, filename="少し複雑なパスモデル:顕在変数のデータ"} head (d_indicator)``` `lavaan` のパスモデルとして表記したものが以下となります。潜在変数間の関係、以下の場合では`motivation_to_learn` 、`c_humanities` と`c_science` の関係は回帰(regression)として`~` を用いて表現します。また、顕在変数間の関係を設定する場合にも同様に`~` を用いて表します。```{r, filename="少し複雑なパスモデル:モデルの表記"} <- ' # latent variables motivation_to_learn =~ time_learning + payment_for_textbooks c_humanities =~ japanese + english + social c_science =~ science + math + social # regressions c_humanities + c_science ~ motivation_to_learn ' ``` `scale` 関数で正規化します。`sem` 関数に作成したパスモデルと顕在変数のデータを与えると因子負荷量を計算することができます。```{r, filename="少し複雑なパスモデル:因子負荷量の演算"} <- scale (d_indicator)<- sem (model = Model_edc, data = d_indicator_scaled)``` `predict` 関数で評価することができます。```{r, filename="潜在変数の予測結果"} predict (fit_edc) |> head ()``` `lavaanPlot` 関数で表示するとより複数なパスモデルでも因子負荷量を演算できていることがわかります。```{r, filename="少し複雑なパスモデル:演算結果の表示"} :: lavaanPlot (model = fit_edc, coefs = TRUE )``` `lavaan` を用いることで複雑なパスモデルでも構造方程式モデリングを利用することができます。また、エラー項の分散や共分散を設定したモデルや、顕在変数間の回帰を加えたモデルも利用できます。また、ベイジアンネットワークのようにスコアを用いてパスモデルの妥当性を比較検討する手法も`lavaan` は備えています。[ 参考文献 ](references.qmd#構造方程式モデリング) で学んだ上でどのようなパスモデルが評価可能であるのか検討し、自分のデータを評価するとよいでしょう。